为什么我们应该放弃定义敏感数据?

个人数据与人以及其他个人数据深深地交织在一起,它就像一幅巨大的挂毯,而这些线是无法轻易拆开的。尝试定义敏感数据就像徒劳地试图从挂毯中找出不同的线头一样,线头与其他线头交织在一起,一旦开始拆线,整个挂毯就会散开。

编者按

在实务当中判断一个数据是否为敏感数据是一个时常困扰隐私从业人员的问题。“照片是不是敏感数据,在什么场景下是敏感数据?”往往不同的人会给出不同的答案。在隐私从业人员不断精进自己判断能力的同时,或许可以思考该判断题是否本身就存在问题,即判断敏感数据是不是本就是一个不可能完成的任务?

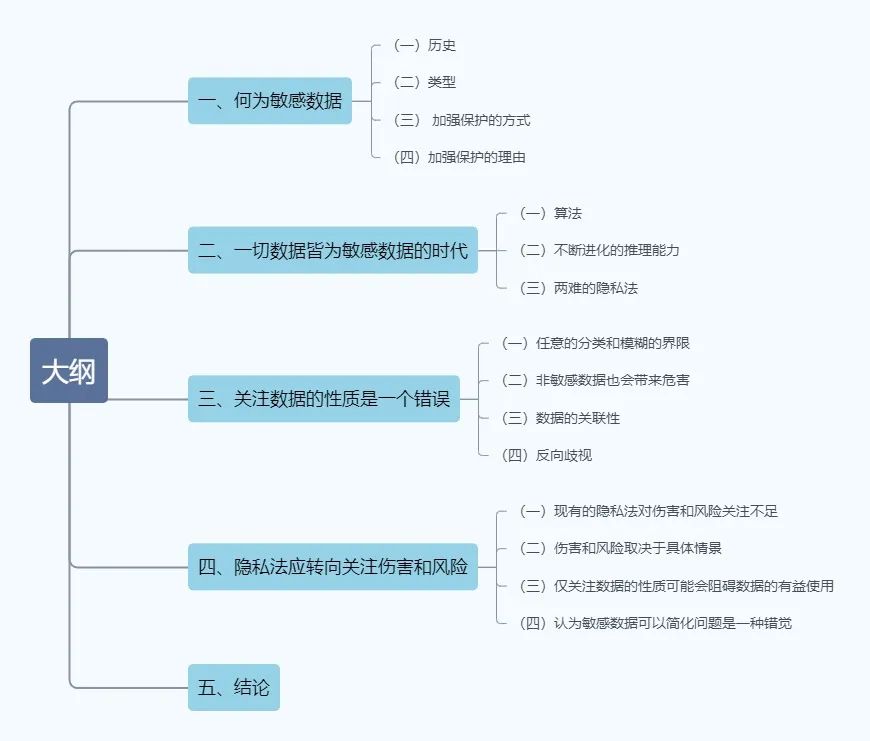

在下面的文章中,作者认为敏感数据的划分是任意的、模糊的、缺乏统一认定方法的。同时,随着大数据和强大的机器学习算法的出现,所有个人数据都有可能推断出敏感信息,这事实上消解了敏感数据的概念。作者强调了隐私法未来应关注于数据收集、使用和传输相关的伤害和风险,而不仅仅是数据性质,数据保护措施应与数据收集、使用和传输所涉及的伤害和风险相称。

作者简介:

Daniel J. Solove,乔治华盛顿大学法学院教授

文献来源:

Solove, Daniel J., Data Is What Data Does: Regulating Based on Harm and Risk Instead of Sensitive Data. 118 Northwestern University Law Review 1081 (2024)

一、何为敏感数据?

(一)敏感数据的历史

敏感数据最初于 20 世纪 70 年代初出现在瑞典和德国黑森州的早期隐私法中。

经济合作与发展组织(OECD)在其 1980 年颇具影响力的《隐私准则》中承认了敏感数据,但只是对其进行了简单的描述,没有具体说明应如何保护敏感数据或哪些类型的数据应被视为敏感数据。

1981年,欧洲委员会第108号公约承认敏感数据,其中提到的类别包括种族出身、政治观点、宗教或其他信仰、健康和性生活,这些类别是非排他性的。

1990 年的《联合国计算机数据档案管理准则》承认了与敏感数据类似的数据类别,但这一概念侧重于歧视。

随着敏感数据概念的形成,出现了关于它应该是开放列表还是封闭列表的争论:

1980 年,经合组织隐私准则采取了开放列表方式。经合组织隐私准则的解释性备忘录指出,没有任何数据本质上是“敏感”的,必须考虑不同国家的不同文化传统和民众的不同态度,并结合数据的语境和使用方式来判断。

1995 年,《欧盟数据保护指令》要求所有欧盟成员国加强对敏感数据的保护。与《经合组织隐私准则》不同,该指令明确规定了敏感数据的类型:"成员国应禁止处理揭示种族或民族血统、政治观点、宗教或哲学信仰、工会会员身份的个人数据,以及处理有关健康或性生活的数据。"指令要求每个成员国都必须为指令中提到的敏感数据类别制定保护措施,但该清单是一个封闭的清单,它只是一个最低限度的清单。一些国家制定了开放式敏感数据清单的法律,另一些国家则制定了封闭式清单的法律。

GDPR 于 2016 年颁布,在指令中的列表中添加了几个额外的敏感类别,包括遗传数据、生物识别数据和性取向。与该指令不同的是,GDPR 是一个封闭列表,成员国不能承认其他类别的敏感数据,但同时GDPR 规定了一个例外,即成员国可以针对基因数据、生物识别数据或有关健康的数据维持或引入进一步的条件。

美国长期以来一直拒绝承认敏感数据。但从2020 年开始,各州消费者隐私法开始加强对敏感数据的保护。美国第一部消费者隐私法是 2018 年的《加州消费者隐私法》(CCPA)。最初,CCPA 不承认敏感数据,但 2020 年的《加州隐私权法》(CPRA) 增加了对敏感数据的加强保护。随后,受 CCPA 和 CPRA 启发,科罗拉多州、弗吉尼亚州、犹他州和康涅狄格州均通过了包含敏感数据的消费者隐私法。

(二)敏感数据的类型

隐私法在其识别的敏感数据类别上有很大的重叠,但它们也有许多差异。在2019年对112个国家的敏感数据定义的分析中,GDPR定义的数据类别最为常见。一个主要的差异是,许多其他国家的法律将犯罪记录列为敏感数据,而GDPR没有(尽管GDPR为犯罪记录提供特殊保护)。其他常见的敏感数据类型包括信用信息和身份号码或文件。

各个司法管辖区的情况相当复杂,这使得遵守法律变得相当具有挑战性。组织必须对其个人数据进行映射,以识别哪些数据是敏感的。全球 194 个国家中有超过 70% 制定了全面的隐私法(其中大部分包含敏感数据),美国不同州也有 51 多项法律,因此映射哪些数据敏感是一项复杂的任务。

(三)敏感数据加强保护的方式

敏感数据在承认它的法律中受到更多保护。这些保护措施通常包括对数据处理的限制、更频繁地要求在处理数据时获得明确同意,以及要求在处理数据前进行隐私风险评估。

(四)敏感数据加强保护的理由

根据GDPR序言第51条的描述:“个人数据根据其性质与基本权利和自由特别相关,因为处理这些数据的背景可能对基本权利和自由造成重大风险,所以这些数据应受到特定的保护。”欧洲法院在解释为什么对敏感数据进行更严格的保护时引用了这一语言。

欧洲理事会在其关于《现代化公约108》的解释性报告中为敏感数据提供了一个理由,即敏感数据可能涉及“对个人尊严或身体完整性的潜在歧视或伤害风险,其中数据主体最私密的领域,如性生活或性取向,受到影响,或者数据处理可能影响无罪推定。”

1990年的《联合国计算机化数据文件管理准则》包括对敏感数据的加强保护,因为这可能导致“非法或任意歧视”。

二、一切数据皆为敏感数据的时代

今天,我们生活在艾丽西亚-索洛-尼德曼(Alicia Solow-Niederman)所称的 "推论经济(inference economy)" 的环境中。大数据采用了大量复杂的算法来分析数据,其中许多涉及 "机器学习",这些算法随着输入的个人数据量不断增加而不断演进。从一个人的居住地可以推断出他的种族。从一个人的饮食习惯可以推断出他的宗教信仰。从阅读习惯可以推断出哲学信仰。政治信仰几乎可以从任何事情中推断出来,因为越来越多的问题和行为都被政治化了。

从非敏感数据推断敏感数据的几个相对明显的例子:

有关用电模式的数据可以用来推断一个人或一个家庭是否是东正教犹太人。东正教犹太人周六不用电。

有关食物消费的数据可用于推断宗教信仰,如穆斯林、犹太人、印度教徒或不吃特定食物或在特定节日吃特定食物的其他信仰。

有关食物消费的数据可用于推断健康状况,如针对特定疾病的特定饮食(如糖尿病患者的无糖饮食)。

位置数据可用于确定个人访问的宗教或政治机构。

(一)算法

通常,政策制定者和组织在没有大量检查研究文献或没有进行任何研究的情况下,只是基于人类的直觉和常识,就做出了关于哪些数据可以引起敏感数据推论的决定。但研究表明,算法在对敏感数据进行推断方面比人类表现得更好,这意味着人们无法轻易地用自己的常识或直觉来确定推断的容易程度,人类有很多盲点无法看到算法所能推断的东西。

(二)不断进化的推理能力

算法的推理能力正在以惊人的速度发展。在当今的大数据时代,通过算法可以很容易地将个人数据与其他个人数据聚合在一起,进而单独或组合产生敏感数据推论,随着算法使用机器学习并在更大范围内进行训练,敏感数据的推断也变得越来越容易,今天将被标记为非敏感的数据,不久可能就会变成敏感数据。

(三)两难的隐私法

主要的几部隐私法,都明确规定任何可以从中推断出敏感数据的个人数据也将被视为敏感数据。但这带来一个问题,如果敏感数据包括能推断出敏感数据的数据,那么敏感数据就会吞噬几乎所有的个人数据。但如果隐私法不承认可能能推论出敏感数据的数据为敏感数据,那么对敏感数据的保护将毫无意义,因为非敏感数据的推论很容易被使用,从而可以相对容易地绕过对敏感数据的限制。

这意味着敏感数据的规则将基本上成为处理大多数个人数据的主要规则,而个人数据的规则只是一个很小的例外或根本不存在。为了遵守规定,企业可能需要将所有个人数据都视为敏感数据,因为很难确定目前不敏感的数据在将来是否会变得敏感。

有一个著名的事件是查尔斯-杜希格(Charles Duhigg)2012 年在《纽约时报》上报道的塔吉特(Target)事件(原文题名为:How Companies Learn Your Secrets)。

Target公司希望能够预测女性顾客是否怀孕,并在她们怀孕早期的时候就开始向她们推销相关产品。为了实现这个目标,Target开始收集大量的消费者数据,包括购买历史、优惠券使用情况等等。 通过分析这些数据,Target的数据科学家们发现了一些购买行为的模式,可以用来判断一个女性顾客是否可能怀孕。例如,如果一个女性顾客购买了大量的维生素、无味的洗衣皂和棉花球等产品,那么她很有可能怀孕。

基于这些发现,Target开始向潜在的孕妇顾客发送定制化的促销材料,包括孕妇相关的优惠券和广告。然而,有一名十几岁的女孩的父亲愤怒地向Target投诉,他认为Target在未经允许的情况下,向他的女儿推销孕妇产品是不道德的行为。后来,他才发现原来他的女儿确实怀孕了,是Target的促销活动揭示了这个秘密。

三、关注数据的性质是一个错误

将数据视为 "敏感 "数据本质上是一种简化的尝试,它假定收集、使用和披露某些类型的数据通常比其他类型的数据更有害或更有问题,而不是根据具体情况对每种情况进行细致入微的分析。敏感数据的诱惑在于避免模糊的界限和复杂的个案分析,但这些概括过于模糊,因此没有区分的价值。它并没有解决模糊性问题而只是转移了模糊性,即从逐案模糊转变成了对敏感数据的类别模糊。

个人数据与人以及其他个人数据深深地交织在一起,它就像一幅巨大的织锦,而这些线是无法轻易拆开的。尝试定义敏感数据就像徒劳地试图从挂毯中找出不同的线头一样,线头与其他线头交织在一起,一旦开始拆线,整个挂毯就会散开。

(一)任意分类和模糊界限

1.任意性

不同法律对哪类数据属于敏感数据的认定很不一致。全球不同的法律承认不同类型的数据为敏感数据。例如美国的一些隐私法承认地理位置数据是敏感数据,但 GDPR 并不承认。在确定哪些数据应被视为敏感数据方面没有一套总体理论或原则,因此结果是任意的。

2.模糊性

各种类别的定义往往非常宽泛,边界非常模糊,以至于经常会产生这样的问题:哪些类型的数据被包括在内?

比如什么是健康数据?医生的医疗诊断就是健康数据,但在谷歌上搜索与健康状况相关的信息呢?加入某个特定病症的在线群组呢?一个人的健身数据是健康数据吗?一个人的营养摄入量、一个人吃的所有食物的数据又是什么?一个人的体温、睡眠习惯、吸烟和运动量等数据都与健康有关。

(二)非敏感数据也会带来危害

敏感数据可以被看作是一种尝试,目的是识别造成危害风险较高的数据。这可能过于简单,但有时简单比完美更好,因为易于执行是一种优势,而更复杂的方法可能会不断失败,从而比不那么完美的方法更糟糕。但根据上面的论述,敏感数据看似简单,但在显微镜下却相当复杂。

非敏感数据的使用方式可能会造成危害,其危害程度不亚于敏感数据,甚至有过之而无不及。

1.元数据

“元数据”是一个术语,用来描述与通信和互联网使用有关的一类据称无害的个人数据。长期以来,美国法律一直试图将元数据单独列出,给予较少的保护。

根据宪法第四修正案,电话或电子邮件其内容受到第四修正案和电子监控法规的严格保护,但与之相关的元数据不是。但试图区分封套信息和内容信息本身就是错误的,封套信息可能也非常具有信息量,人们有时最关心的可能是保护与之打交道的人和组织的隐私,而不是他们所说的具体内容。

各种无伤大雅的数据经过组合和分析,可以揭示出关于一个人的大量信息。美国最高法院在地理位置数据方面已经认识到了这一点。法院在United States v. Knotts 一案中裁定,一个人在公共场合驾车时通过设备被追踪,并没有合理的隐私预期,因为其行踪是 "自愿传达给任何想看的人"。但在 Carpenter v. United States一案中,法院对数据的广泛性表示担忧。法院指出,地理定位数据涉及 "一个人在数年内每天、每时每刻实际存在的详细编年史。各种无伤大雅的数据经过组合和分析,可以揭示出关于一个人的大量信息。

2.地址

地址很少出现在敏感数据清单上,但一旦泄露,其危害性可能相当大,有时甚至关乎生死。女演员 Rebecca Shaeffer 因一名跟踪者从机动车辆部获得其地址而被谋杀,从而促使联邦《驾驶员隐私保护法》的通过。也曾有法官在家中遇袭,一名枪手来到联邦法官埃斯特-萨拉斯的家中,杀死了她的儿子,打伤了她的丈夫,案件发生之后2022年底,国会通过了《丹尼尔-安德烈司法安全与隐私法案》,该法案以萨拉斯法官被杀儿子的名字命名,该法限制出售和披露法官的家庭住址。

一些敏感数据清单包括地理定位数据,据称其中包括地址,但法律并不涉及地址,只涉及跟踪个人移动和位置的数据。

3.性格类型

人格类型可以用来影响人们的购买、网页浏览、投票或其他决策。在一项涉及 350 万人的研究中,研究人员发现,"根据个人的心理特征匹配劝说性的内容,会显著改变他们的行为,具体表现为点击量和购买量。

研究和实践表明,各种类型的数据都可以用来推断人格。语言使用与性格类型相对应。研究人员在分析了参加性格测试的 75,000 名志愿者的 1430 万条 Facebook 消息后,开发出了可用于预测五大性格特征的词云。一个人的 "数字足迹也可用于推断其性格 ,一项研究能够根据智能手机数据预测五大性格特征,这些数据涉及人们的音乐收听、应用程序使用、通信活动和手机总体使用情况。

对于那些试图塑造人们行为的营销人员来说,性格类型是一个主要的焦点。有关人格类型的数据与一个人生活的许多方面紧密相连,可以被用来以强有力的方式操纵他人。这是敏感数据列表中的一个明显疏漏。

4.照片

照片的使用可能会造成极大的危害。也许是因为照片的使用非常广泛,所以很少被列入敏感数据列表。GDPR 试图通过在 Recital 51 中指出以下几点来应对照片带来的挑战:“对照片的处理不应被系统地视为对特殊类别个人数据的处理,只有通过特定技术手段进行处理,允许对自然人进行独特识别或认证时,才符合生物鉴别数据的定义”。

GDPR 的说明似乎认为照片的唯一敏感数据类别是生物识别数据,但照片可以导致对种族、民族、健康、宗教等的推断。穿着宗教服装或有特殊发型、面部毛发或头饰的人的照片可导致对宗教信仰的推断。照片可以从眼睛或身体上看出吸毒和上瘾的迹象。各种健康状况的身体表现都可以通过照片捕捉到。

5.社会阶层

敏感数据类别被纳入隐私法往往是因为歧视,那为什么将社会阶层排除在外呢?Mary Anne Franks在Democratic Surveillance一文中表示“对于社会中地位较低的人来说,监视并不仅仅意味着互联网搜索受限或网购意愿下降;它可能意味着整个生存都受到监视,每一个个人选择都有可能带来身体伤害”。

(三)数据之间具有关联性

敏感数据的主要理由是保护基本权利和自由免受高风险情况的影响,或保护免受歧视。然而,这些危害可以通过非敏感数据轻易实现。

点击流数据不在敏感数据列表之列,但它经常被用作敏感数据的替代。点击流数据可以揭示人们的种族、宗教、政治观点和哲学信仰等大量敏感数据。使用点击流数据的组织不需要从中推断出敏感数据,他们只需使用点击流数据向人们发送有针对性的信息,或操纵人们的行为。而使用点击流数据可以达到与使用敏感数据相同的目的,而不会触发敏感数据规定。

个人数据与人以及其他个人数据深深地交织在一起,它就像一幅巨大的织锦,而这些线是无法轻易拆开的。尝试定义敏感数据就像徒劳地试图从挂毯中找出不同的线头一样,线头与其他线头交织在一起,一旦开始拆线,整个挂毯就会散开。

(四)反向歧视

当隐私法保护种族、民族和性取向方面的歧视,而不保护年龄或性别方面的歧视时,这就把这些不受保护的歧视降到了不太重要的地位。这造成了一种反向歧视,即确暗示这些情况不值得保护。

四、隐私法应转向关注伤害和风险

敏感数据方法之所以失败,是因为它错误地将数据的性质视为确定适当保护级别的首要因素。如上文所述,数据的性质并不能说明什么问题,最重要的是伤害(Harm)和风险(Risk)。伤害是指收集、使用或传输个人数据对个人或社会造成的负面影响。风险是指发生伤害的可能性和伤害的严重性。

法律不应该仅仅为了保护数据而保护数据,而是应该是为了防止或补救伤害而保护数据。某些类型的个人数据本身并不具有伤害性,只有当它们被使用(或有可能被使用)在某些方式时,它们才会具有伤害性或产生伤害的风险。

一种更为比例相称的方法比敏感数据的简化两级方法更可取。保护程度应与损害或损害风险成比例地变化。当然,在制定法律,并不是所有的伤害都是可知的。因此,应该制定一项涵盖广泛的规定,以涵盖可能出现的风险或伤害。已知的伤害应该得到解决,例如歧视、操纵、情绪困扰和声誉损害等等。

(一)现有的隐私法对伤害和风险关注不足

风险和伤害当然是许多隐私法的一部分,但它们的作用还不够大。例如,GDPR有时采取基于风险的方法。第24条在要求采取适当的技术和组织措施保护数据时考虑风险。第25条中,风险是评估数据保护设计和默认适当措施的因素。第32条考虑风险以确定适当的安全措施。在第35条中,风险是触发进行数据保护影响评估(DPIA)的要求的关键因素。

不幸的是,GDPR在其他规定中对伤害和风险的关注不够:

1.DPO

GDPR要求组织在其涉及大规模系统性监控数据主体、大规模处理根据第9条(敏感数据)或第10条所述的特殊类别的个人数据或有关刑事定罪和犯罪事实的个人数据”时,指定数据保护官(DPO)。

也许GDPR试图通过规定处理敏感数据时触发DPO要求来解决伤害和风险问题,但如上所述,敏感数据与伤害和风险之间的关联性较差,敏感数据的方法包含了太多不高风险的情况,并忽略了太多高风险的情况,有无数的使用情况会造成伤害或高风险,而这些情况不在GDPR的规定之内。

2.DPIA

尽管GDPR关注涉及“对自然人的权利和自由的高风险”的情况,但它却将敏感数据的处理列为高风险的固定情况。在这里包括敏感数据会带来更多问题,因为它错误地鼓励组织过分关注敏感数据,并低估了涉及非敏感数据的情况。

同时,高风险场景触发的隐私风险评估陷入一个奇怪的循环。评估据称是为了确定风险,但又在评估之前推测出哪些是风险。归根结底,高风险情况的初步判断往往是基于显而易见的风险做出的。更彻底的做法是将基于风险的方法作为一种常规做法,覆盖更广泛的风险评估。风险评估不应仅限于高风险情况,中度风险仍不应忽视。

(二)伤害和风险取决于具体情景

伤害和风险取决于具体情况,它们很少能在具体情境之外确定。对所有情况一视同仁,往往不能为高风险情况提供充分的保护,并且对低风险繁琐和不必要的限制会减弱隐私规则的权威性。

例如:许多隐私法都会将宗教信仰视为敏感数据,但如果不知道这些数据将如何使用,就不清楚采取何种保护措施是适当的。假设这个人是宗教领袖,将这些数据保密是没有意义的,甚至违背了人们的愿望。而如果这些数据被用来因信仰而歧视,那么这种使用将是有害的。有意义的保护需要集中于阻止数据被用于伤害。

(三)仅关注数据的性质可能会阻碍数据的有益使用

1.可能导致企业停止收集有益于弱势群体的信息

例如,企业可能选择与慈善机构合作,以推动多元化计划。作为计划的一部分,企业可能希望通过在线发布商投放广告,为慈善机构筹集捐款,并将广告针对那些对慈善机构的多元化目标感兴趣的个人组成的受众群体。然而,如果追踪读者对与身份或意识形态相关的问题的兴趣被视为敏感数据,那么在线发布商将停止维护此类受众群体的画像,这将影响企业推动多元化计划的能力,无法将广告重点放在最有可能对此感兴趣的用户上,从而对最终的筹款计划产生影响。

2.可能扼杀与身份和意识形态相关的言论

泛化的敏感数据概念将导致企业开始自我审查,不再与任何收集、使用或共享与“敏感个人信息”有关的信息发布者合作,不再提供与身份和意识形态有关的在线内容,以避免处理敏感个人信息所涉及的法律问题。然而社会正义事业在现代已经发展到公开讨论身份和意识形态问题。

例如,“黑人生命也是命”抗议活动表明,人们越来越关注世界各地边缘化社区尚未解决的社会正义问题。

事实上,世界已经从一个掩盖个人身份和意识形态的地方转变成了一个各种声音可以汇聚在一起,创造、观看和分享包含其独特身份和观点的内容的地方。阅读边缘化群体的斗争的新闻可以激发更多的理解、同理心,并在理想的情况下采取行动来解决这些令人担忧的问题。

3.可能会威胁到边缘化群体访问数字内容的能力

如果用户对此类内容感兴趣的相关信息被认为泄露了个人身份和意识形态,那么出版商将无法在网上免费提供此类内容。因此,经济上处于不利地位的社区将无法获得有关身份和意识形态的有价值的教育内容、有关如何参与社会正义事业的信息,以及表达他们对这些问题的想法的媒介。

此外,改变基于广告收入的免费用户数字模式很可能无法解决这一问题。

例如,一份在线订阅的时事通讯如果因为担心可能构成敏感的个人信息而较少收集与身份和意识形态有关的使用数据,就不可能知道从哪些读者那里获得选择同意来发送与身份和意识形态有关的内容。因此,即使在这种替代模式下,作者也无法向对社会正义问题感兴趣的个人发送相关内容。

4.可能会阻碍社会正义的实现

保护敏感数据,保护隐私有时会被当做阻碍社会进步的借口。

加利福尼亚州的“种族隐私倡议”是指2003年提出的一项反对平权行动的公民投票倡议,旨在禁止收集有关种族或族裔的数据,以对抗平权政策。

该倡议的支持者认为,禁止收集种族数据可以保护个人的隐私,并避免种族歧视。他们认为,平权政策应该基于个人的能力和资格,而不是基于种族或族裔身份。然而,该倡议的反对者认为,了解种族和族裔的数据可以帮助政府和组织了解潜在的不平等现象,并采取相应的措施来促进平等和公正,禁止收集种族数据可能会阻碍对种族不平等问题的研究和解决。最终,该倡议在2003年的公民投票中被否决。虽然并未成为加利福尼亚州的法律,但这一事件引发了关于种族数据收集和平权政策的广泛讨论和辩论。

禁止收集敏感数据可能会阻碍对不平等问题的研究和解决(以种族为例):

(1)数据支持研究:种族数据的收集可以提供重要的信息,帮助研究人员和政策制定者了解不同种族群体之间存在的不平等问题。这些数据可以揭示教育、就业、住房、医疗和刑事司法等领域的种族差异,并帮助确定是否存在系统性的不平等待解决。

(2)发现潜在的歧视:种族数据的收集可以帮助揭示潜在的歧视现象。通过分析种族数据,可以发现不同种族群体之间的差异待遇,例如就业机会、工资水平、晋升机会等方面的差异。这有助于发现和解决潜在的歧视问题,并采取措施促进平等和公正。

(3)监测政策效果:种族数据的收集可以用于监测和评估平权政策的效果。通过追踪种族数据,可以确定平权政策是否取得了预期的成果,是否有助于减少种族不平等。这种监测和评估可以帮助政策制定者做出调整和改进,以更好地解决种族不平等问题。

(四)认为敏感数据可以简化问题是一种错觉

1.对伤害-风险理论的批评

法律不关注伤害和风险,很可能是因为其复杂,而敏感数据似乎很简单。但正如之前阐述的那样,敏感数据方法其实并不简单。保罗-欧姆(Paul Ohm)认为虽然敏感数据方法可能是武断的,会导致对数据的保护不足或过度,但“伤害-风险”方法不太可能被政策制定者认可,因为“隐私伤害”:

(1)缺乏传统伤害的显著性,因此很容易被忽视

(2)表述非常抽象,无法与安全或经济效率等其他利益相提并论

(3)不适合进行测试或证伪

2.在敏感数据的概念上做文章是徒劳的

因担心政策制定者会发现制定基于危害和风险的监管方法具有挑战性,欧姆认为重新解释敏感数据是一个退而求其次的好选择,并提出了改进方法:

(1)他将识别敏感数据分为四个因素:伤害的可能性;造成伤害的可能性;保密关系;以及风险是否反映了多数人的担忧。

(2)他还建议采用 "威胁模型 "的方法来分析危害,并主张扩大敏感数据的范围,将精确的地理位置、生物识别数据和元数据也包括在内。

具有讽刺意味的是,欧姆为改进敏感数据所做的大部分努力都涉及到对伤害和风险的考虑。但由于担心监管者会抵制,欧姆敦促将伤害和风险纳入敏感数据的保护伞之下,而不是抛弃伤害和风险。欧姆的本能是关注伤害和风险,但他无法放下敏感数据,因为他被其虚假的简单性所吸引。但对敏感数据的执着会阻碍他的威胁建模方法,而如果没有敏感数据的阻碍,这种方法本身会好得多。

五、结论

不应认为存在争议和模糊是一种无法克服的缺陷,因为敏感数据的边界更不明确。虽然法律不能针对每种情况做出不同的处理,但法律可以关注的是情景类型,而不是数据类型。隐私是极其复杂的,而且与环境密切相关。过度简化的监管是无效的,而且往往适得其反,因为它没有降低复杂性,而只是试图将其掩盖起来。

尽管对数据敏感程度分类的方法简单易用,但敏感数据所带来的好处只存在于问题被忽视的情况下。在推论时代,基于数据类型的简单区分已经失去了意义,几乎所有个人数据都可能具有敏感性,而隐私法对现代算法和推论的影响尚未完全吸收。关注伤害和风险,以及各种个人数据使用场景是不可避免的。尽管我们不愿意这样做,但为了更好地保护隐私,我们没有其他选项。

编译整理:陆天渊

声明:本文来自越洋网事,版权归作者所有。