【笔记】打卡01 | 初学入门

初学入门:01-02

- 01 基本介绍

- 02 快速入门

- 库

- 处理数据集

- ==网络构建==

- 模型训练

- 保存模型

- 加载模型

- 打卡-时间

01 基本介绍

MindSpore Data(数据处理层)

ModelZoo(模型库)

MindSpore Science(科学计算),包含了业界领先的数据集、基础模型、预置高精度模型和前后处理工具

MindSpore Insight(可视化调试调优工具),能够可视化地查看训练过程、优化模型性能、调试精度问题、解释推理结果

02 快速入门

库

import mindspore

from mindspore import nn

from mindspore.dataset import vision, transforms

from mindspore.dataset import MnistDataset

处理数据集

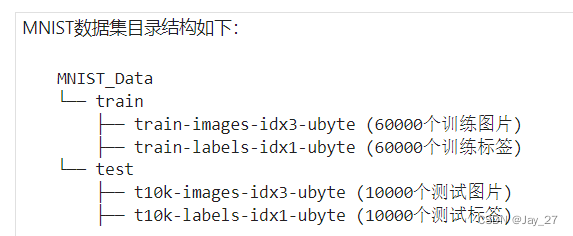

下载Mnist数据集

# Download data from open datasets

from download import downloadurl = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)

训练集、测试集

train_dataset = MnistDataset('MNIST_Data/train')

test_dataset = MnistDataset('MNIST_Data/test')

列名:图片 和 对应标签(分类)

数据处理流水线(Data Processing Pipeline)

参数:数据集、batch_size

def datapipe(dataset, batch_size):image_transforms = [ vision.Rescale(1.0 / 255.0, 0),vision.Normalize(mean=(0.1307,), std=(0.3081,)),vision.HWC2CHW()]label_transform = transforms.TypeCast(mindspore.int32)dataset = dataset.map(image_transforms, 'image')dataset = dataset.map(label_transform, 'label')dataset = dataset.batch(batch_size)return dataset

首先,数据变换(Transforms):1、对输入数据(即图片)2、对输出(即标签);

然后,map对图像数据及标签进行变换处理;

最后,将处理好的数据集打包为大小为64的batch

train_dataset = datapipe(train_dataset, 64)

test_dataset = datapipe(test_dataset, 64)

对数据集进行迭代访问

for data in test_dataset.create_dict_iterator():print(f"Shape of image [N, C, H, W]: {data['image'].shape} {data['image'].dtype}")print(f"Shape of label: {data['label'].shape} {data['label'].dtype}")break

网络构建

class Network(nn.Cell):def __init__(self):super().__init__()self.flatten = nn.Flatten()self.dense_relu_sequential = nn.SequentialCell(nn.Dense(28*28, 512),nn.ReLU(),nn.Dense(512, 512),nn.ReLU(),nn.Dense(512, 10))def construct(self, x):x = self.flatten(x)logits = self.dense_relu_sequential(x)return logitsmodel = Network()

print(model)

mindspore.nn类是构建所有网络的基类,也是网络的基本单元。

- 自定义网络时,可以继承

nn.Cell类 - __init__包含所有网络层的定义

- construct(类似前向传播??)包含数据(Tensor)的变换过程。

模型训练

定义损失函数、优化器

loss_fn = nn.CrossEntropyLoss()

optimizer = nn.SGD(model.trainable_params(), 1e-2)

一个完整的训练过程(step)需要实现以下三步:

1. 正向计算:模型预测结果(logits),并与正确标签(label)求预测损失(loss)。

2. 反向传播:利用自动微分机制,自动求模型参数(parameters)对于loss的梯度(gradients)。

3. 参数优化:将梯度更新到参数上。

定义正向计算函数。

def forward_fn(data, label):logits = model(data)loss = loss_fn(logits, label)return loss, logits

使用value_and_grad通过函数变换获得梯度计算函数。

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)

one-step training

def train_step(data, label):(loss, _), grads = grad_fn(data, label)optimizer(grads)return loss

定义训练函数,使用set_train设置为训练模式,执行正向计算、反向传播和参数优化。

def train(model, dataset):size = dataset.get_dataset_size()model.set_train()for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):loss = train_step(data, label)if batch % 100 == 0:loss, current = loss.asnumpy(), batchprint(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")

定义测试函数:用来评估模型的性能。

def test(model, dataset, loss_fn):num_batches = dataset.get_dataset_size()model.set_train(False)total, test_loss, correct = 0, 0, 0for data, label in dataset.create_tuple_iterator():pred = model(data)total += len(data)test_loss += loss_fn(pred, label).asnumpy()correct += (pred.argmax(1) == label).asnumpy().sum()test_loss /= num_batchescorrect /= totalprint(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

训练过程需多轮(epoch)训练数据集

epochs = 3

for t in range(epochs):print(f"Epoch {t+1}\n-------------------------------")train(model, train_dataset)test(model, test_dataset, loss_fn)

print("Done!")

保存模型

模型训练完成后,需要保存其参数。

mindspore.save_checkpoint(model, "model.ckpt")

print("Saved Model to model.ckpt")

加载模型

加载保存的权重

# 1、重新实例化模型对象,构造模型

model = Network()

# 加载模型参数,并将其加载至模型上。

param_dict = mindspore.load_checkpoint("model.ckpt")

param_not_load, _ = mindspore.load_param_into_net(model, param_dict)

print(param_not_load)

param_not_load是未被加载的参数列表,为空时代表所有参数均加载成功。

打卡-时间

from datetime import datetime

import pytz

# 设置时区为北京时区

beijing_tz = pytz.timezone('Asia/shanghai')

# 获取当前时间,并转为北京时间

current_beijing_time = datetime.now(beijing_tz)

# 格式化时间输出

formatted_time = current_beijing_time.strftime('%Y-%m-%d %H:%M:%S')

print("当前北京时间:",formatted_time,'your name')