Attention系列总结-粘贴自知乎

1.

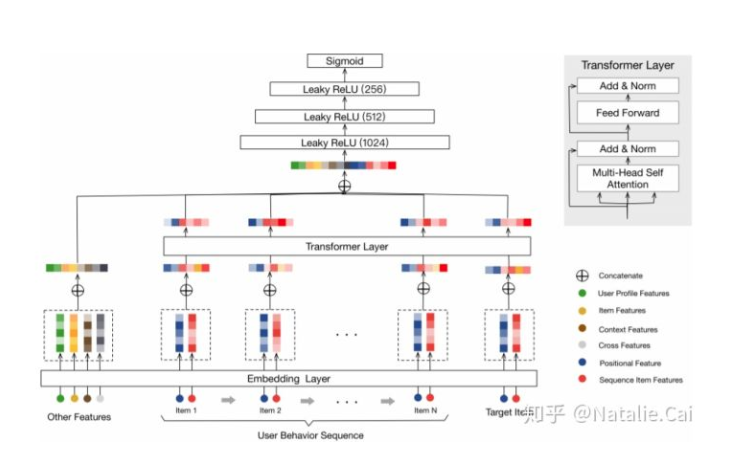

梦想做个翟老师:阿里:Behavior Sequence Transformer 解读48 赞同 · 7 评论文章

优点:捕捉用户行为历史序列中的顺序信息。w2v也是捕捉用户序列信息的,本质差异在于啥?

添加图片注释,不超过 140 字(可选)

阿里将Transformer用于淘宝电商推荐,效果优于DIN和谷歌WDL_AI&大模型_吴少杰_InfoQ精选文章

2. encoder-decoder

Encoder decoder模型和Attention模型