机器学习-线性回归 二维问题

线性回归算法是基于已知样本并在已知样本数据范围内预测的一种监督学习算法

线性回归的特点:目标预测的是连续的数值

二维问题中,在训练样本中,需要学习映射函数f(x) 表达y

设f(x) = ax+b, 用一条直线来拟合样本数据

三位问题中,设预测函数 h(θ) = θ0+θ1*x1+θ2*x2

则在n为问题中,预测函数为:h(θ)==y

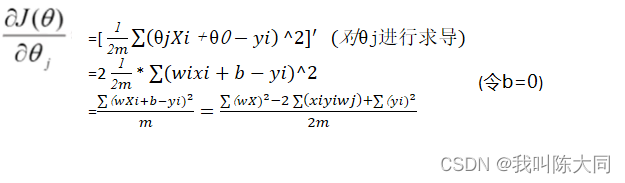

为了评估预测结果的准确度,通过Gradient Descent(梯度下降算法),最小化损失函数,来确定参数值,最终将参数带入计算。

损失函数= J(θ)=1/2m * [hθ(χ(i))-y(i)]^2

while(min_θj>θj){ //一直重复,知道求出来的

θj :=θj-α*(σ/σθj)J(θ)

},其中损失函数求偏导的步骤为:

θj′: = θj+(𝑦𝑖-hθ(𝑋𝑖))𝑋𝑗𝑖

=[ 1/2𝑚 * θ𝑗𝑋𝑖+θ0−𝑦𝑖^2]′ (对θj进行求导)

损失函数: 𝑒𝑗=(yi−𝑤𝑗𝑥𝑖)2=𝑤𝑥𝑖2 −2∗𝑦𝑖∗𝑤𝑥𝑖+𝑦𝑖2

令 a=𝑥𝑖^2 b=𝑥𝑖𝑦𝑖 c=𝑦𝑖^2

则损失函数可简化为:J(w) = (a*w^2 - 2bw + c)/m