[学习笔记]刘知远团队大模型技术与交叉应用L4-Prompt-learning Delta-learning

Prompt-Learning and Delta-Tunning

背景和概览

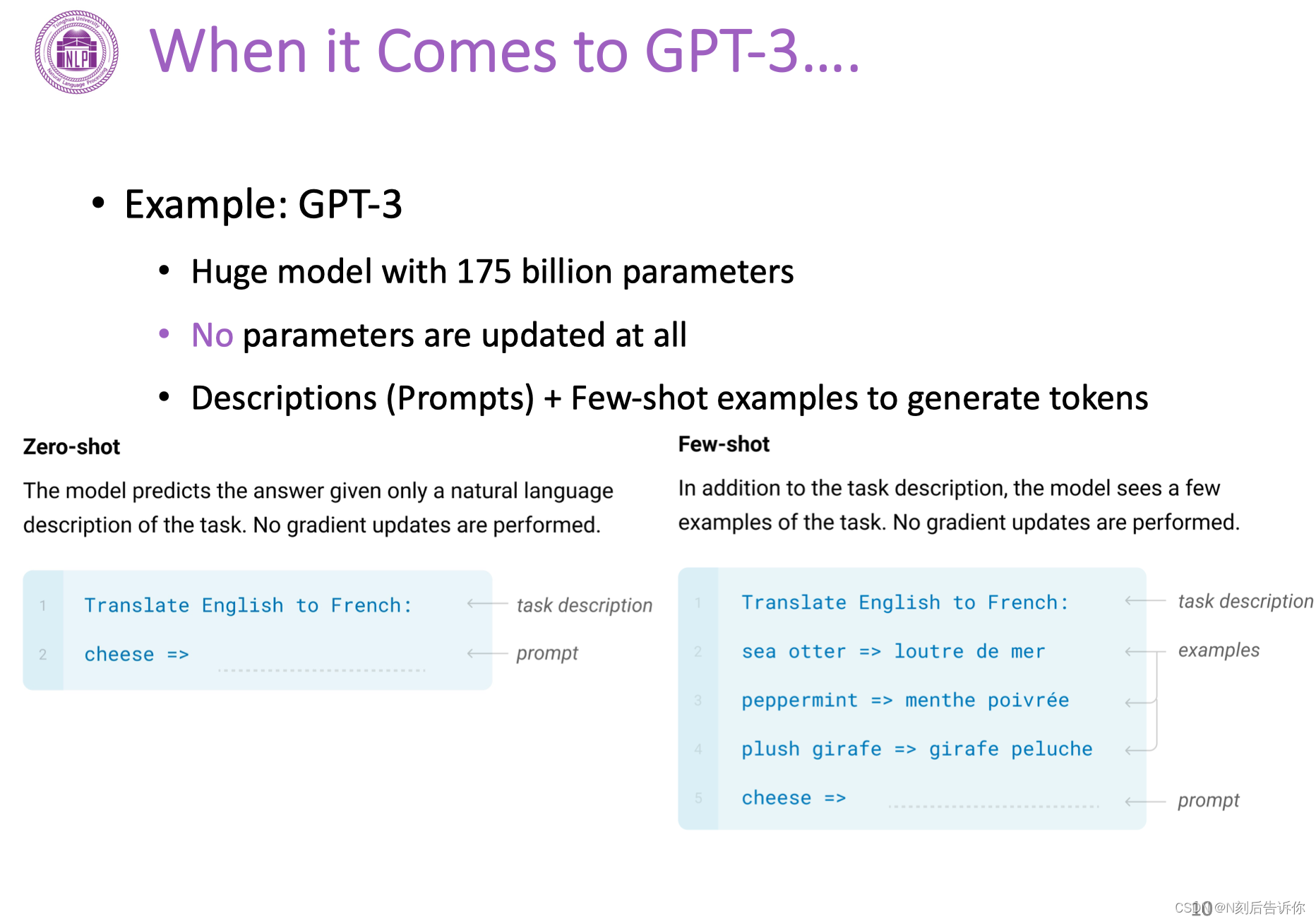

但是从T5开始,大模型越来越大了。

微调很难了。

模型的趋势

Model Scaling:模型越来越大

Difficult Tuning:微调越来越难

Prompt-Learning

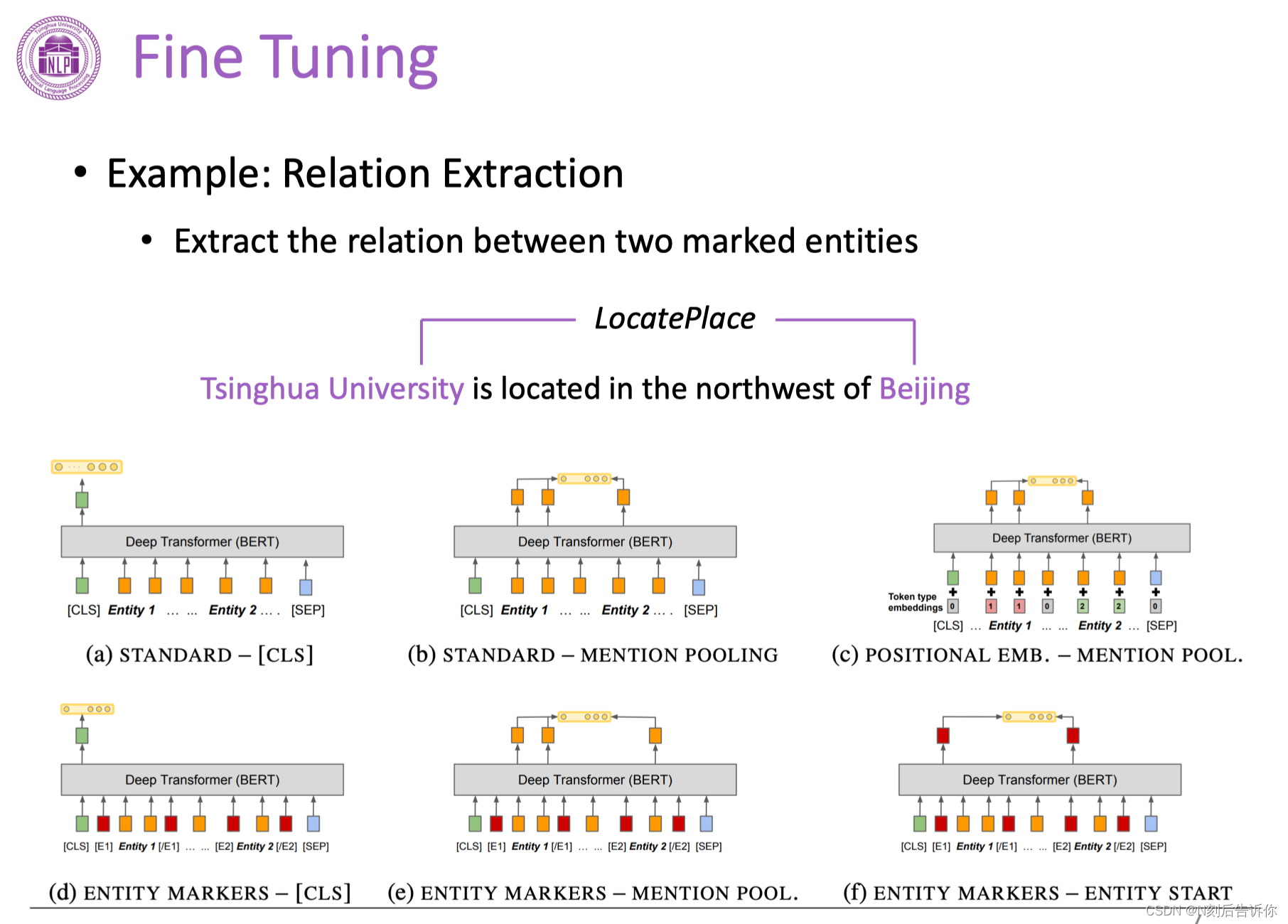

基本组成与流程介绍

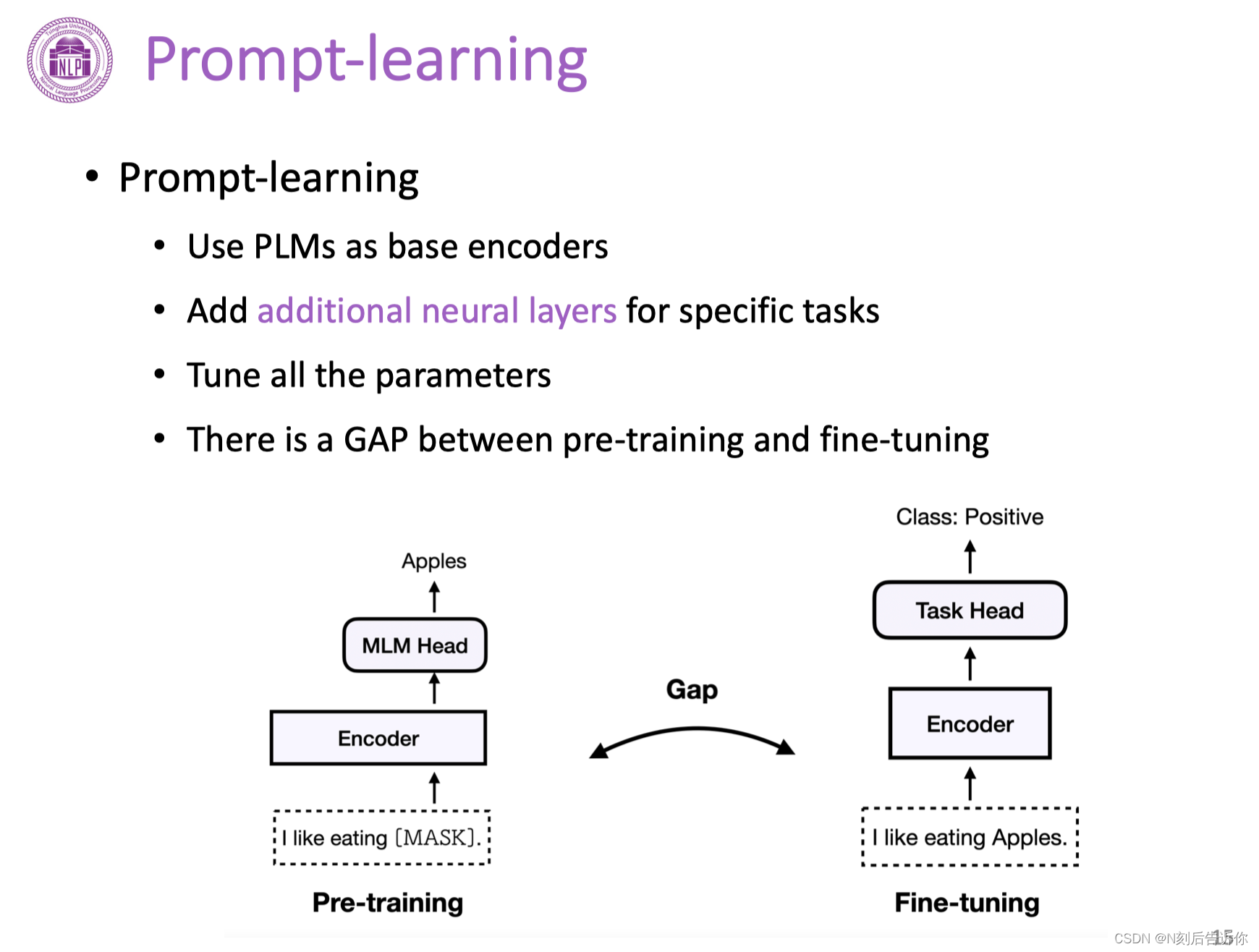

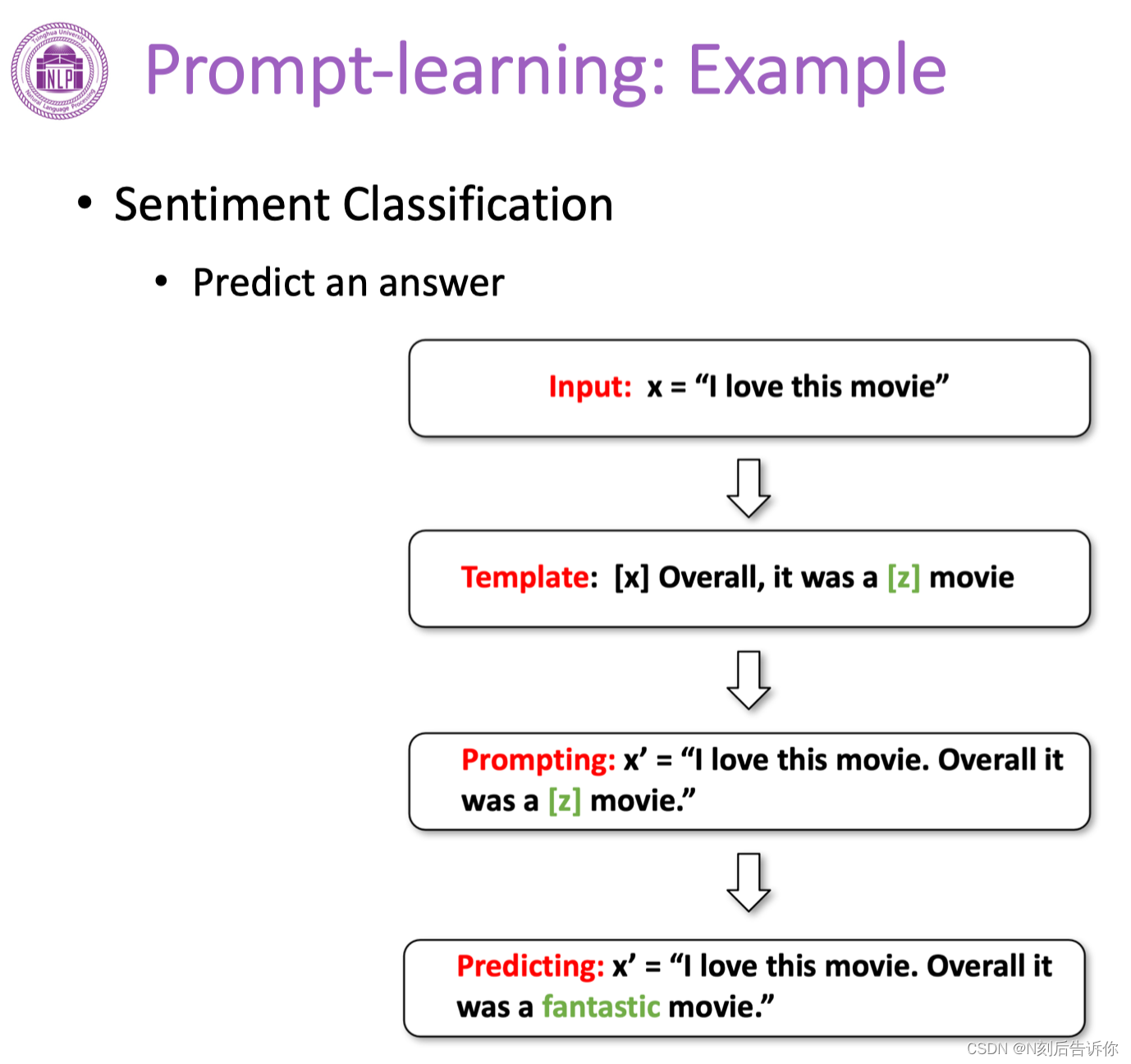

预训练和fine-tuning有一定的gap。毕竟是不同的任务。

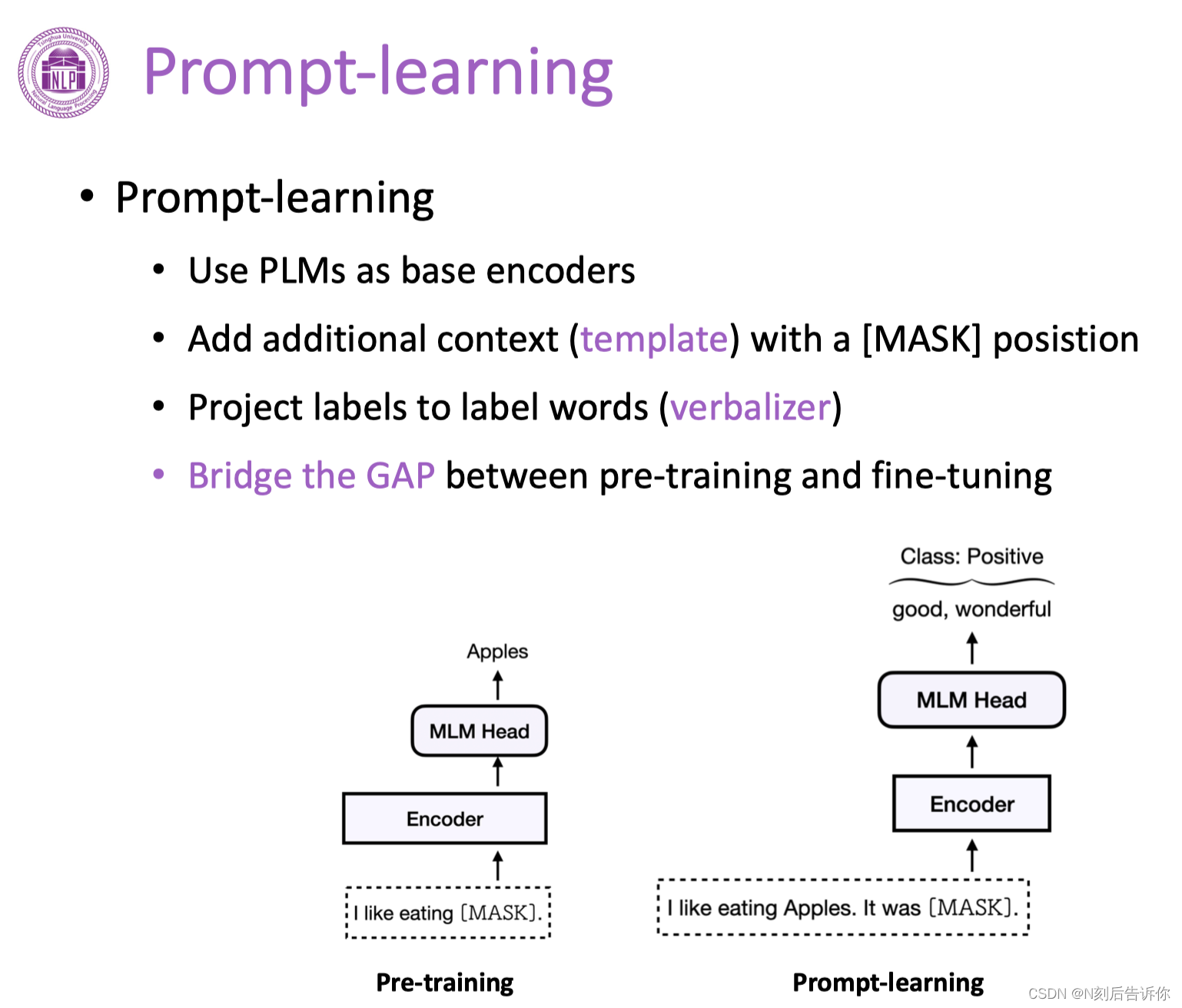

通过额外增加模版。

映射到标签的过程称为verbalizer。

这样就使用了mask任务。弥补了不同之间的gap。

流程举例

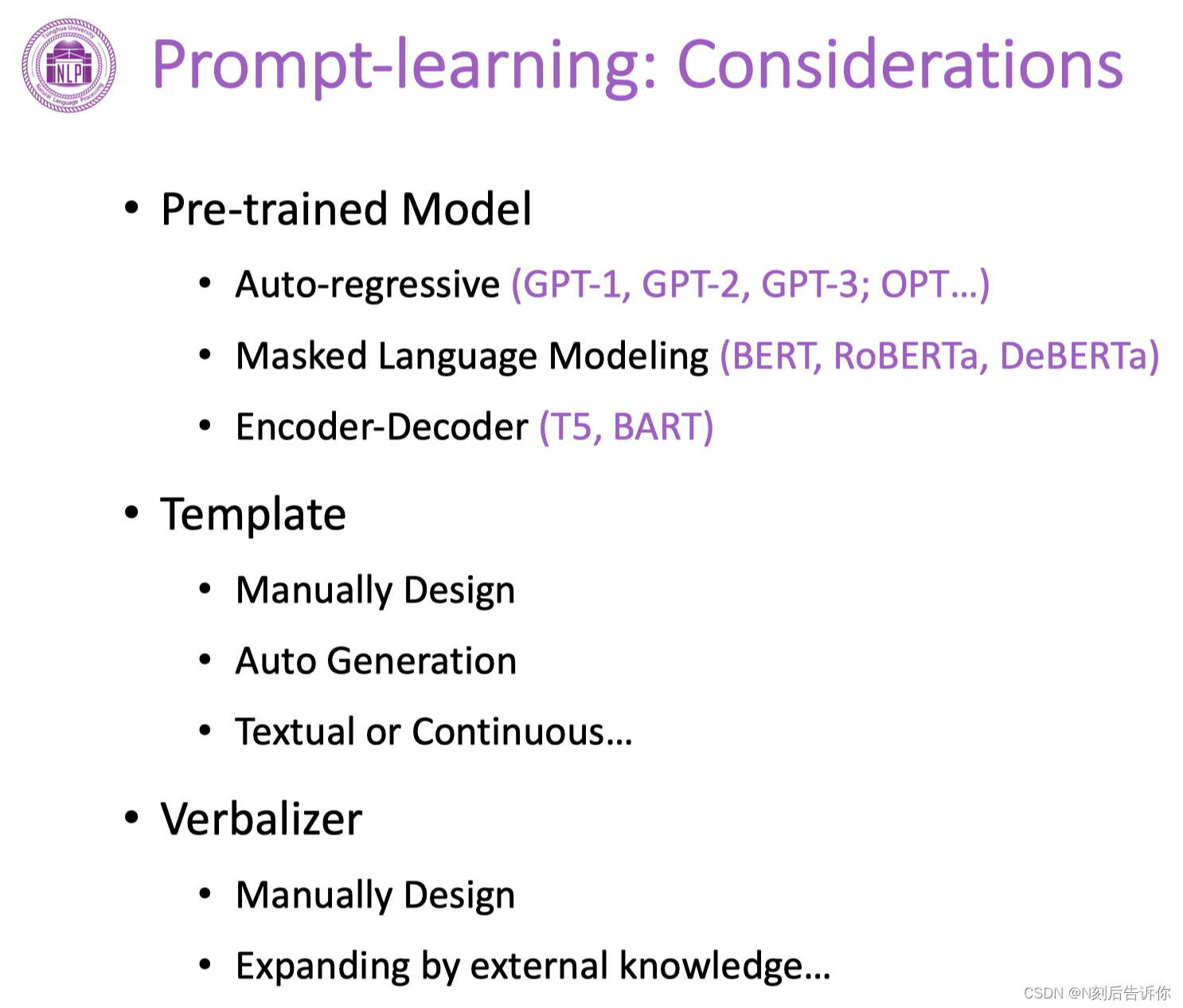

如何考虑PLM,Template,Verbalizer

PLM

Auto-regressive有更好的生成能力,mask往往放最后

MaskLM有更好的理解能力,mask往往放中间

Encoder-Decoder,mask位置可以随意

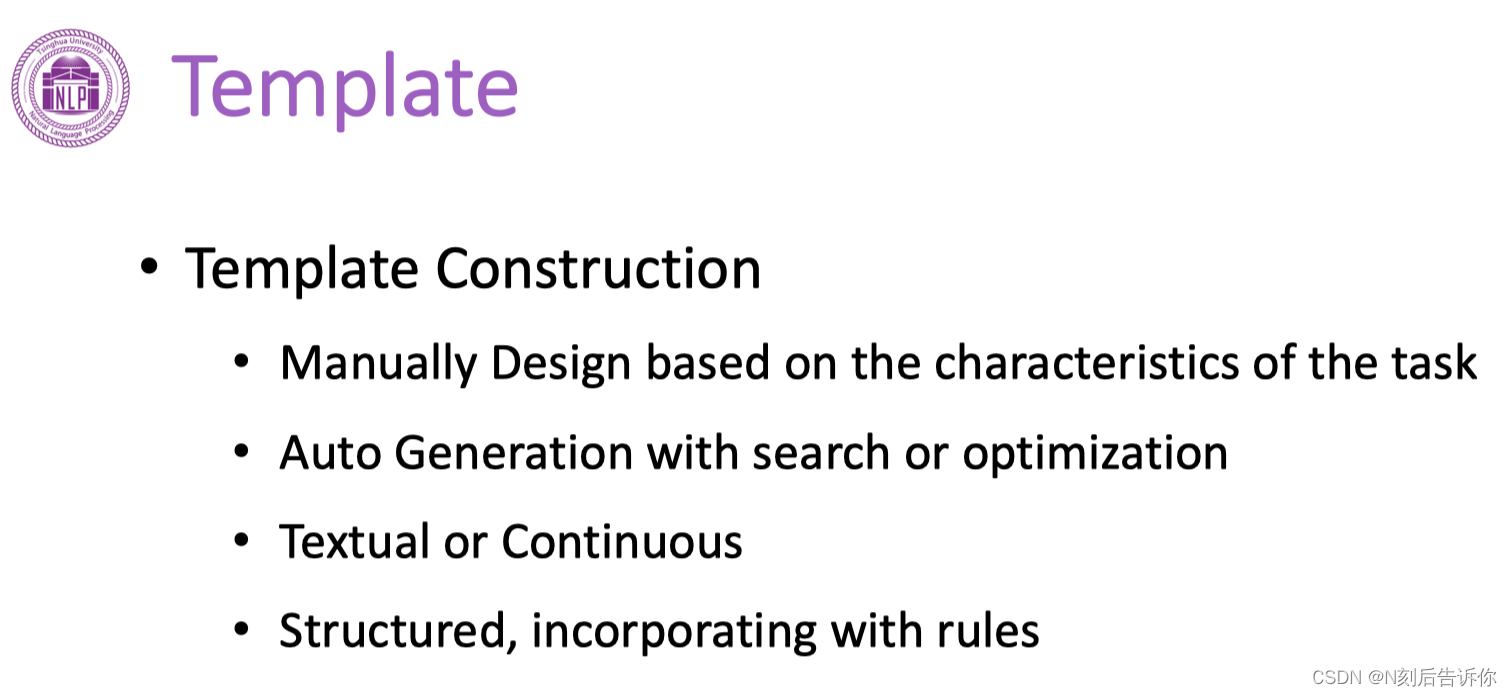

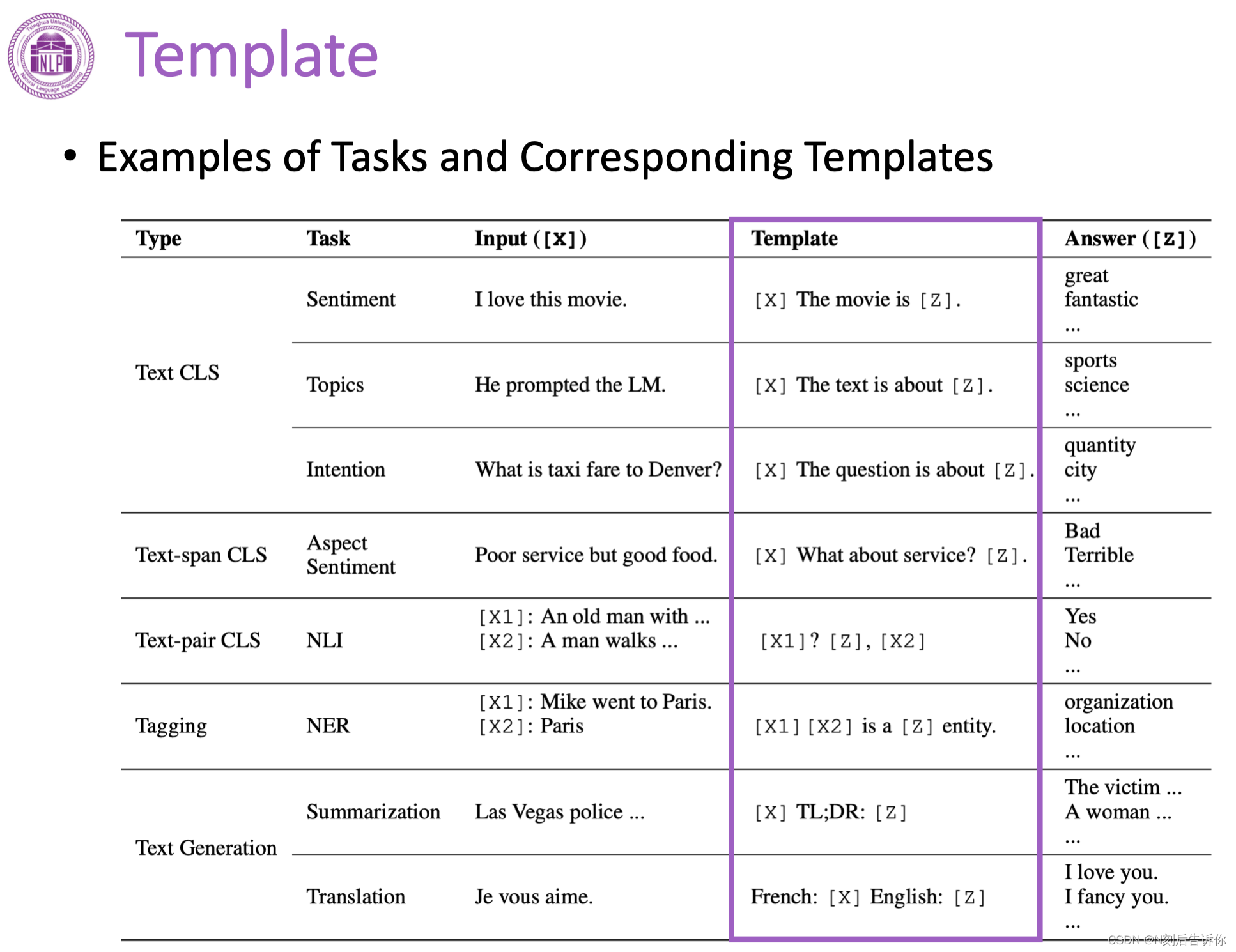

Template

人工构造

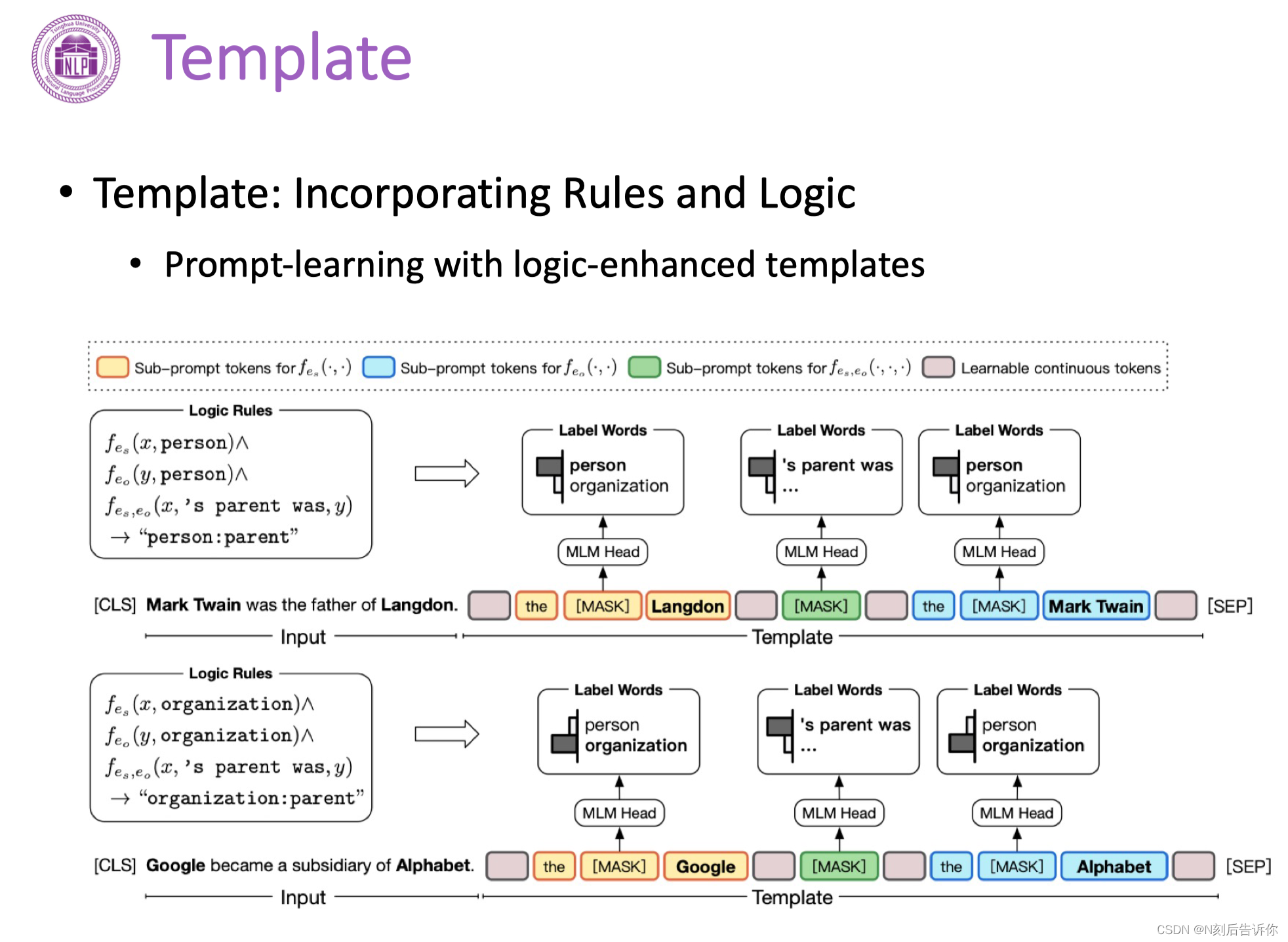

人为加入规则

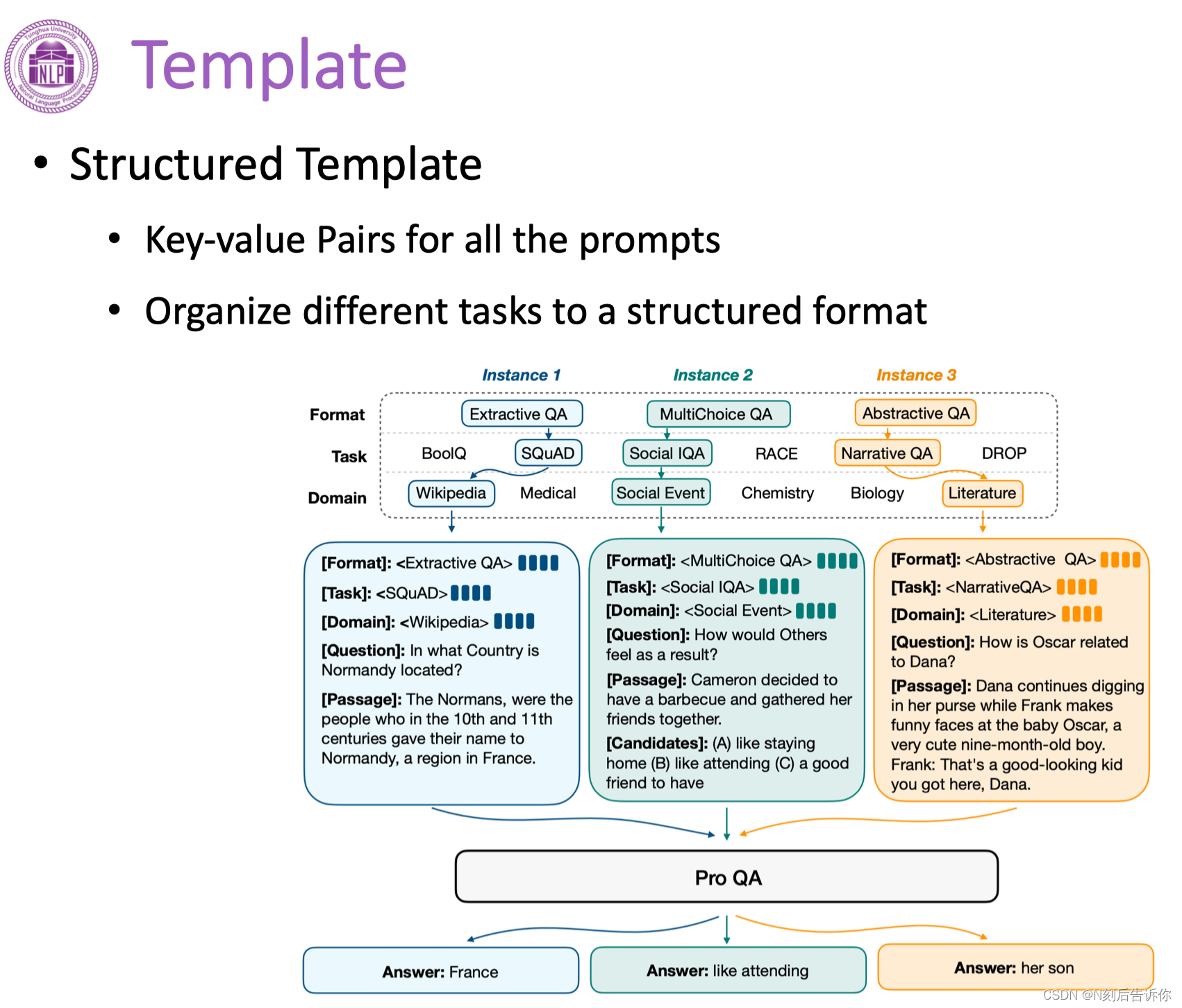

结构化的Template

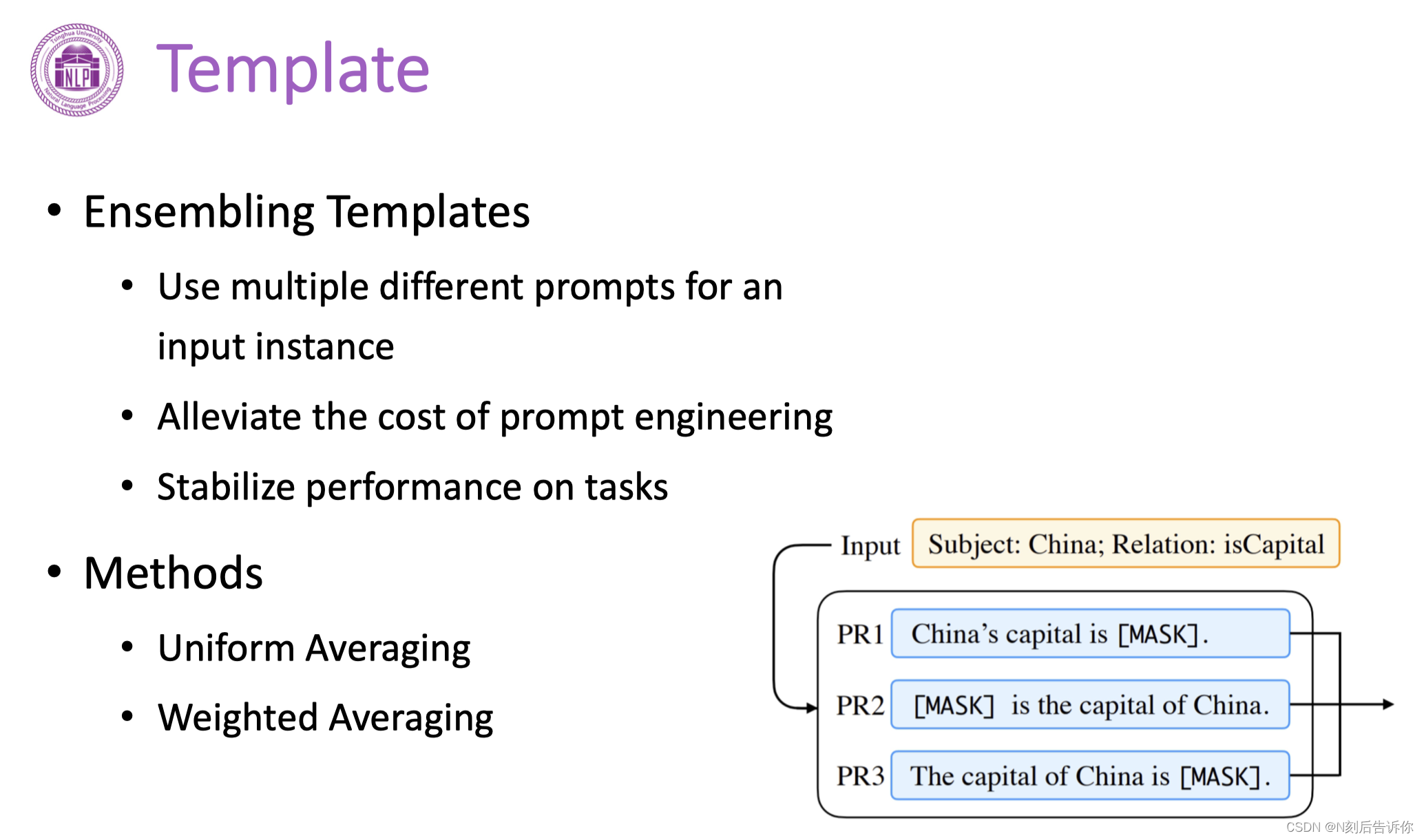

多个template整合

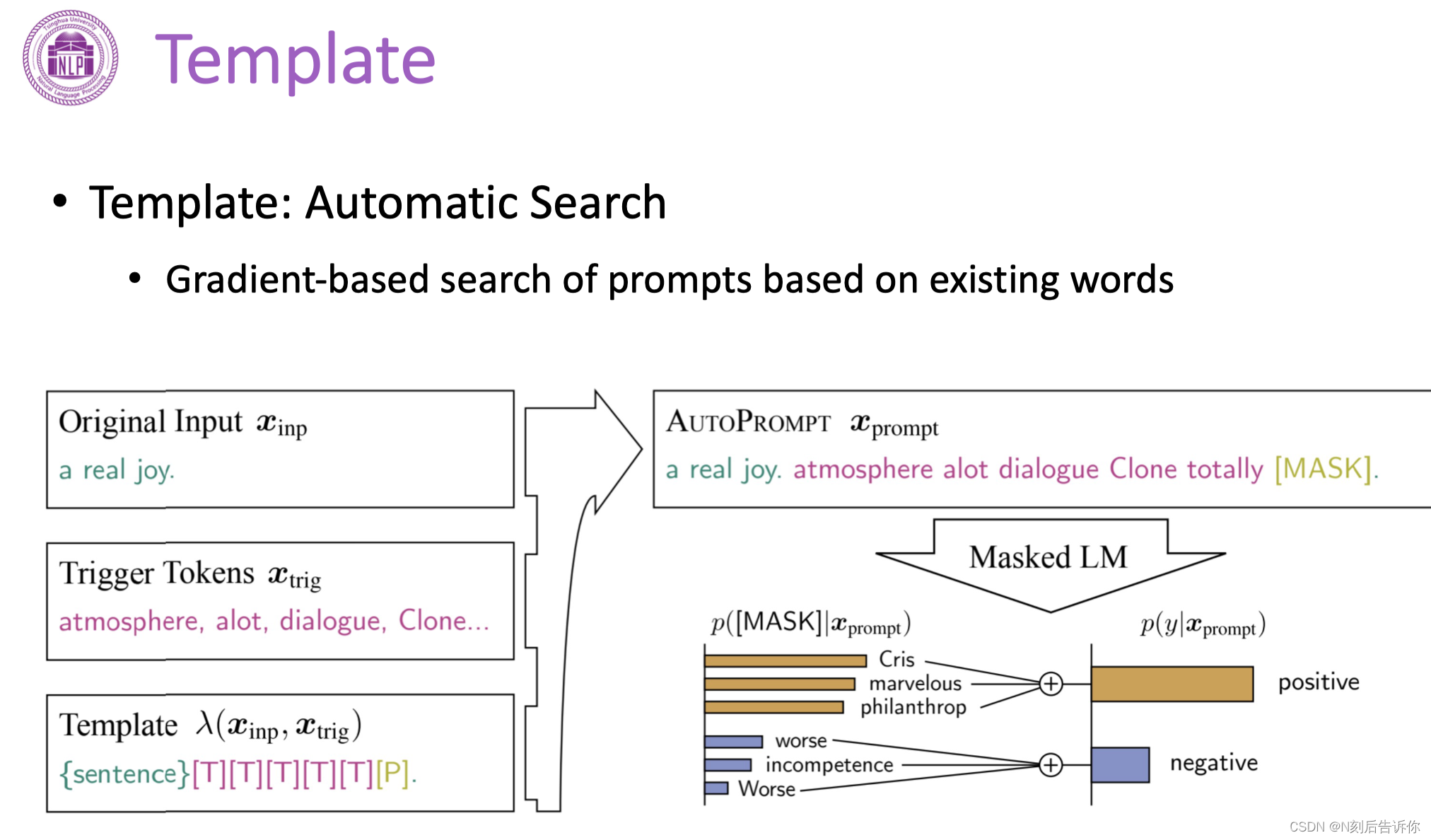

自动template

最终的template可能没有含义,但是work

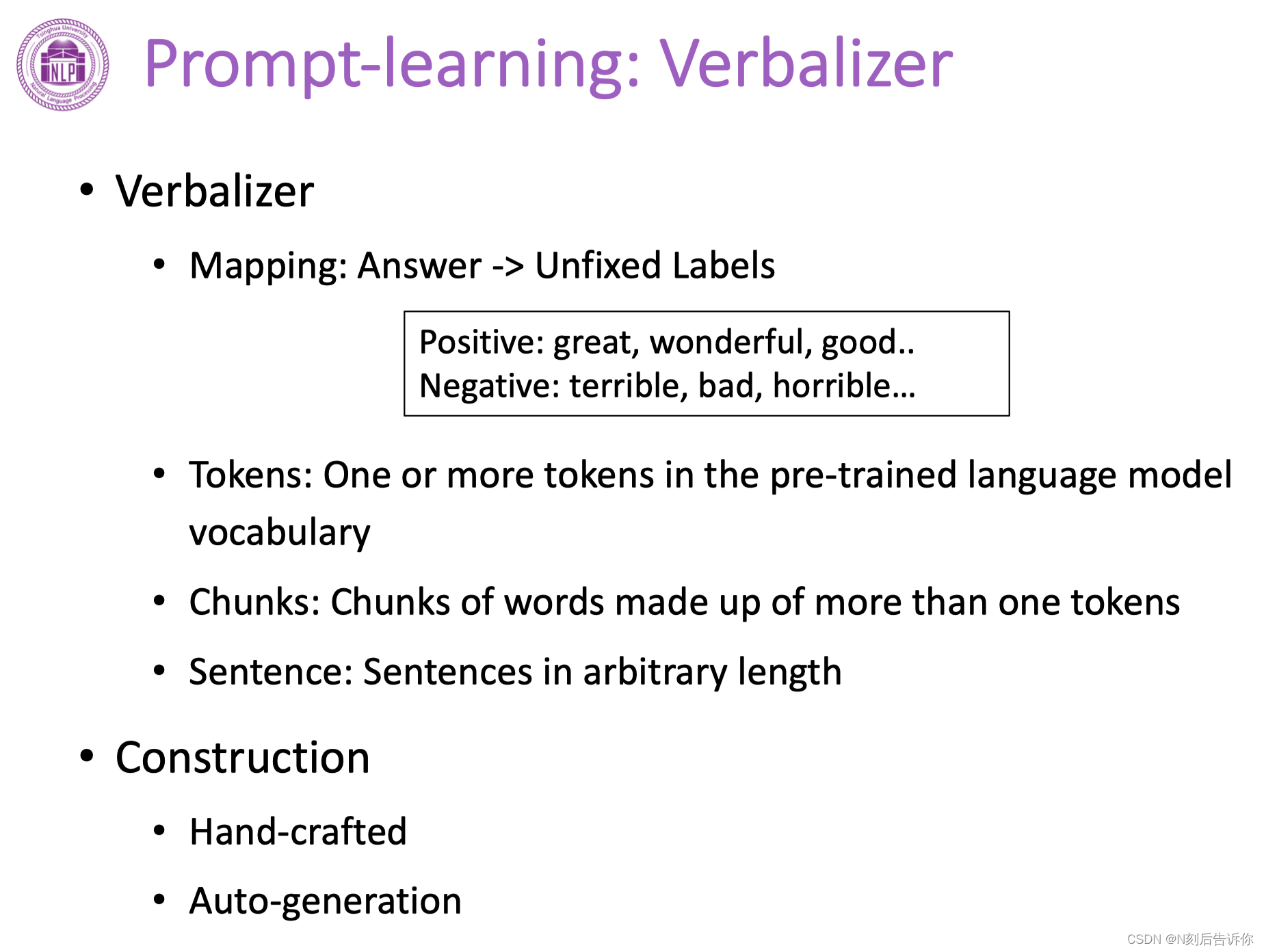

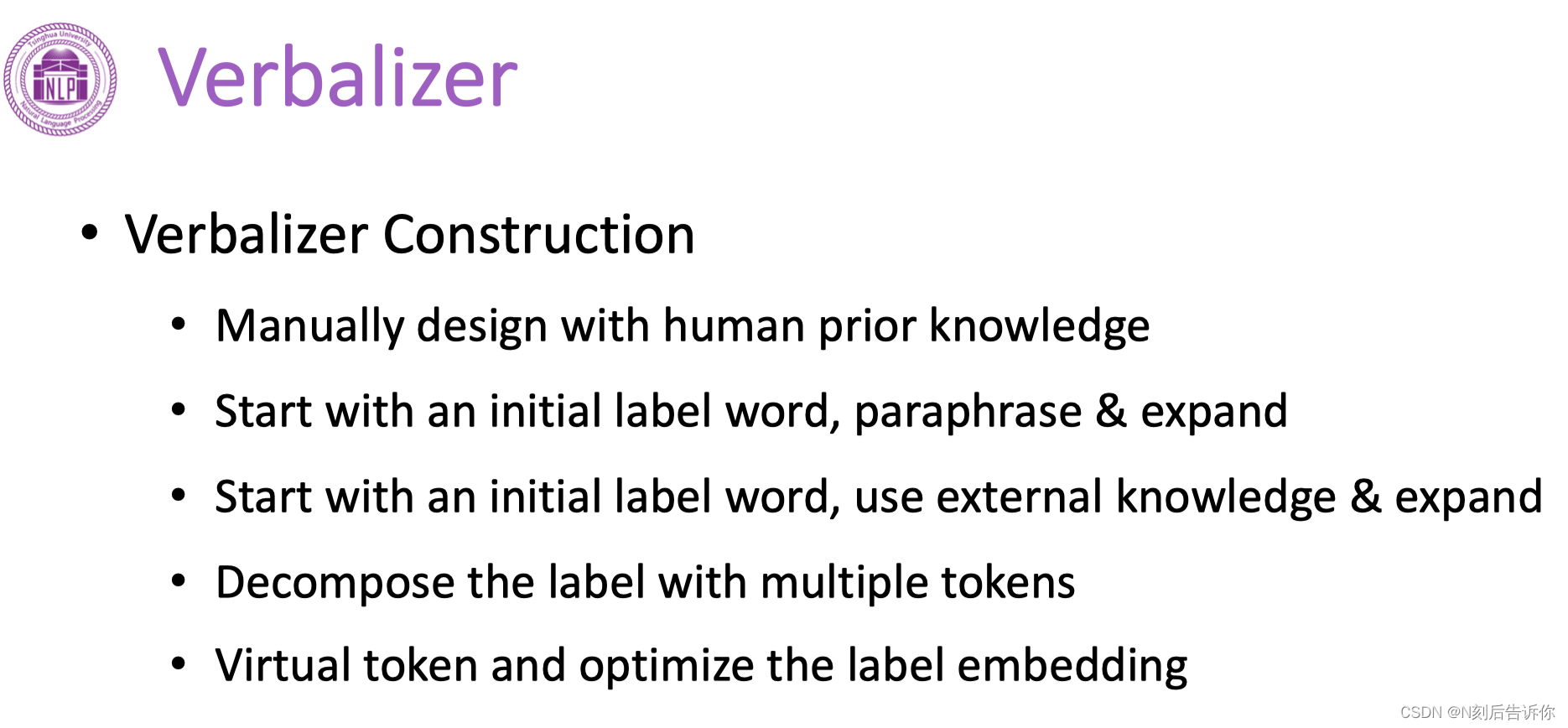

Verblizer

把标签映射成标签词的过程。

本质上是如何用模型预测得到的分布,用它完成分类或者生成。

人为构造

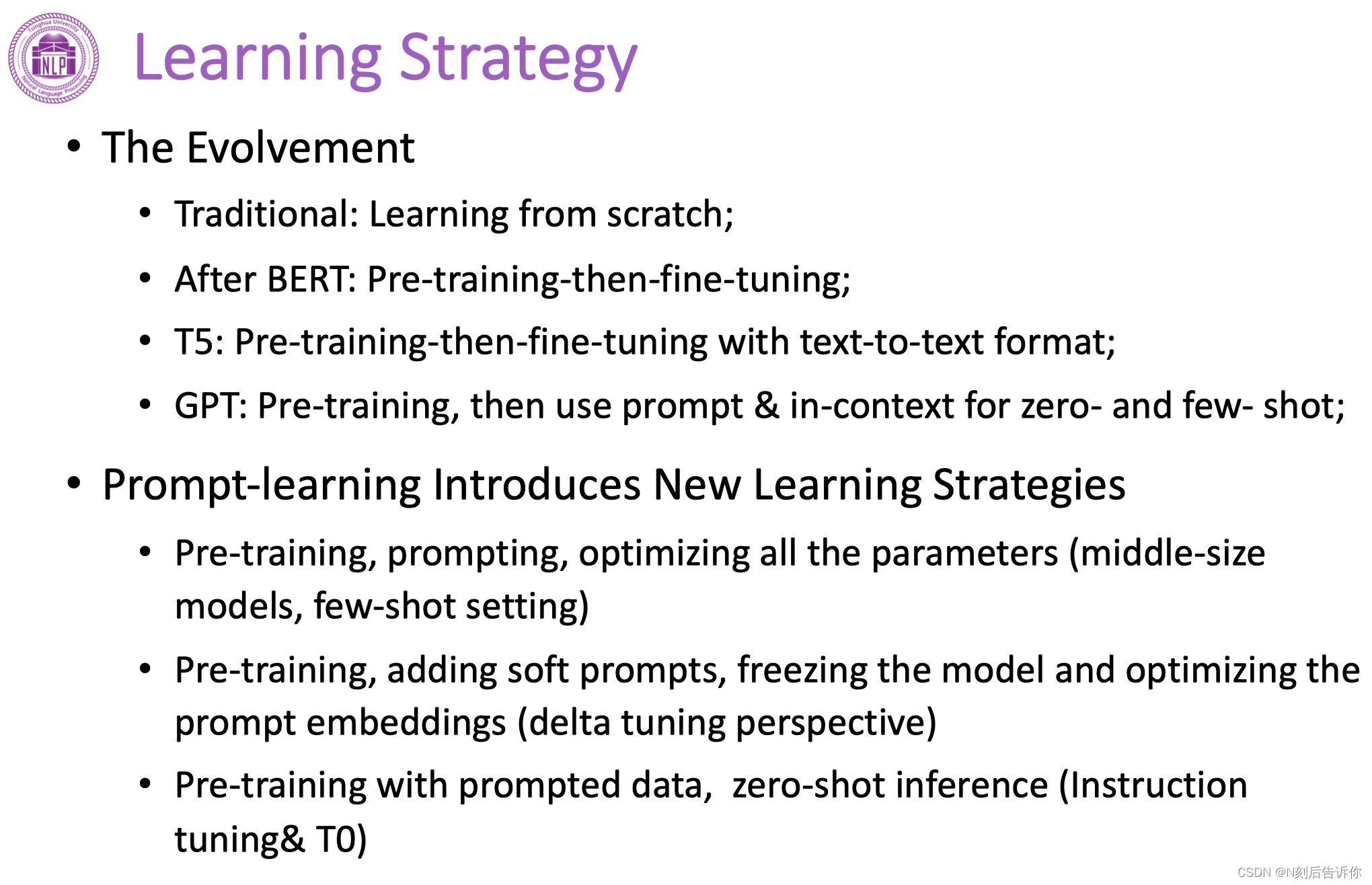

训练新范式

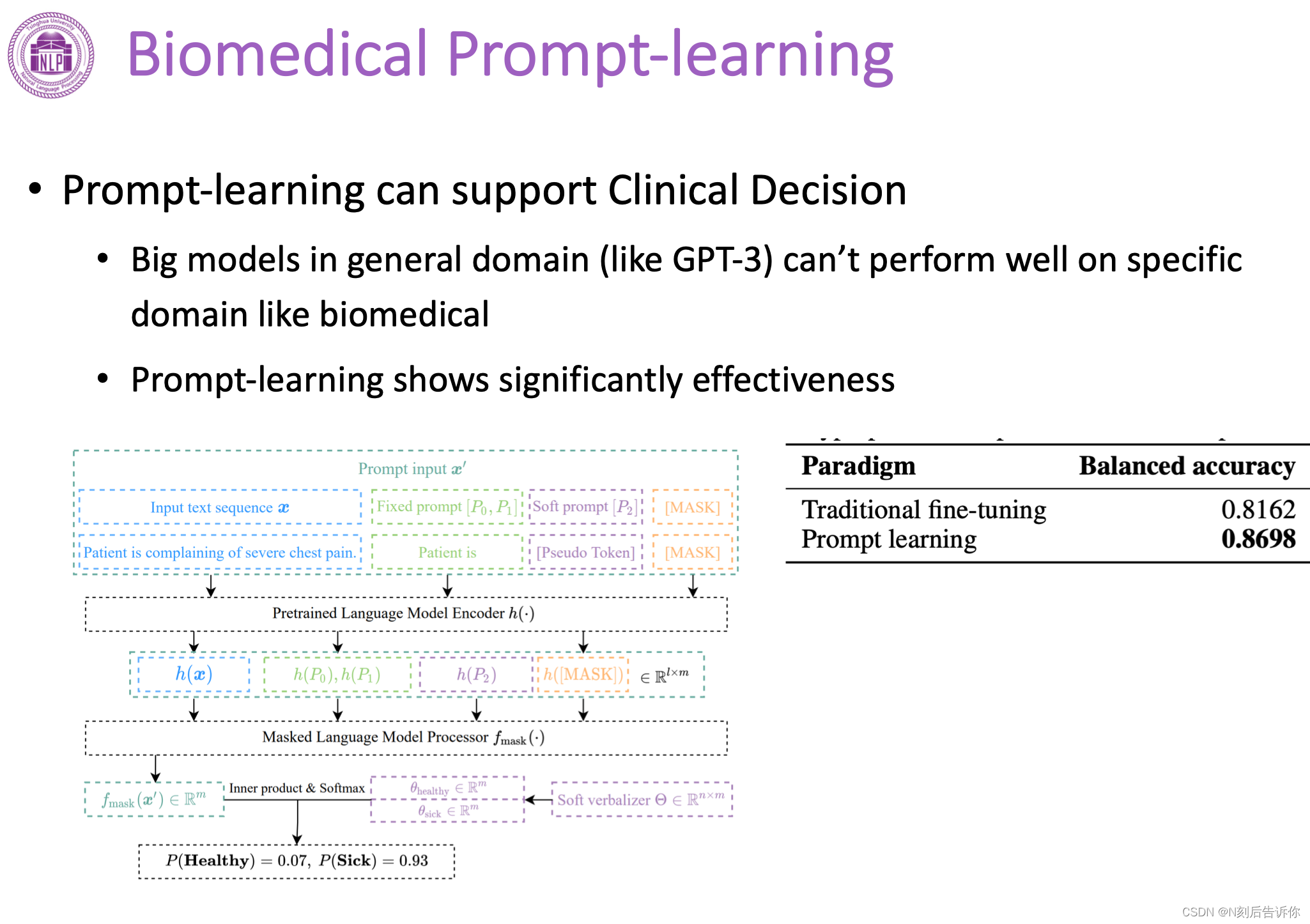

应用

总结

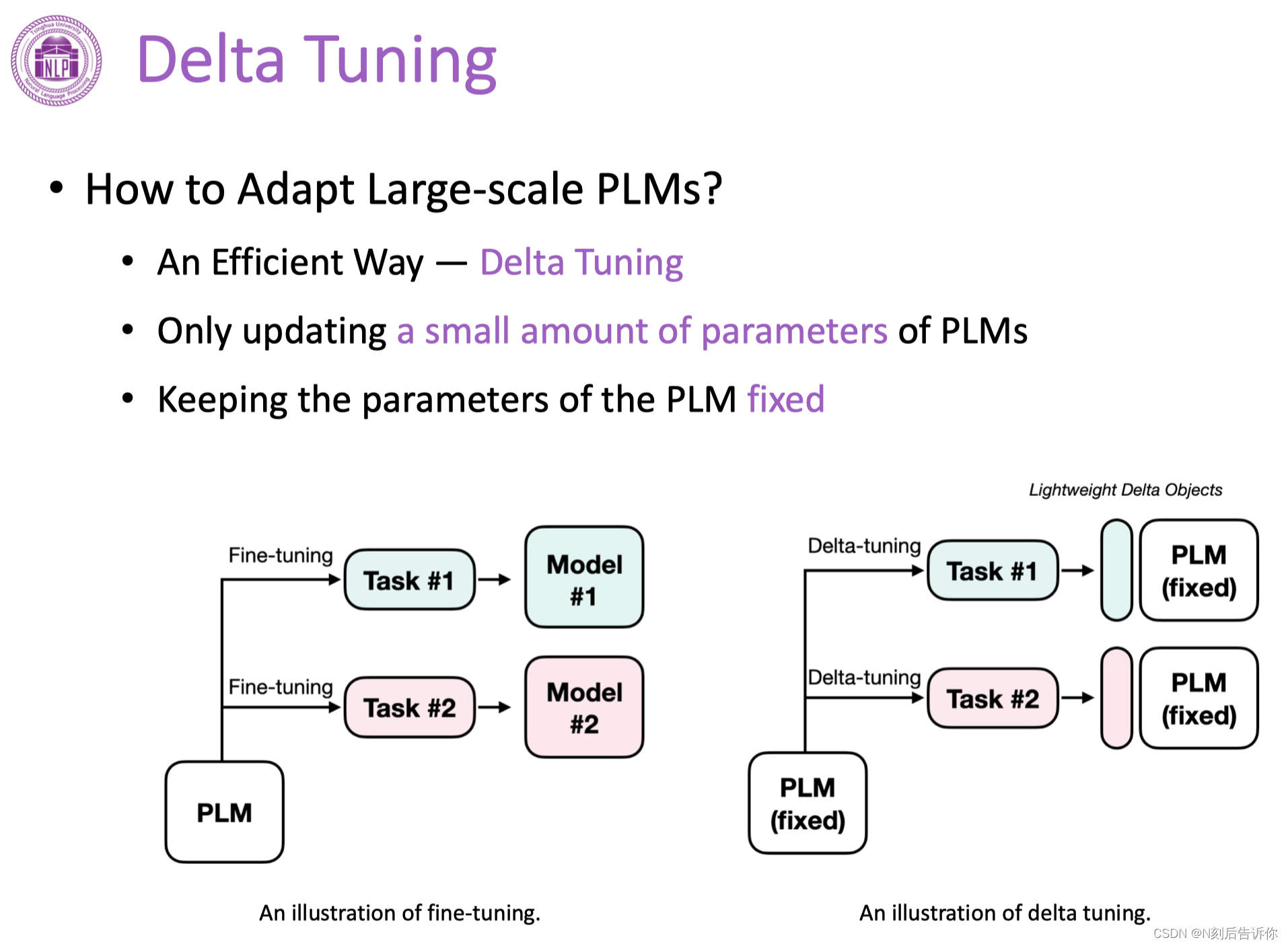

Delta-Learning

背景与介绍

大模型有Universal Knowledge,Delta Tuning可以将他激发出来。

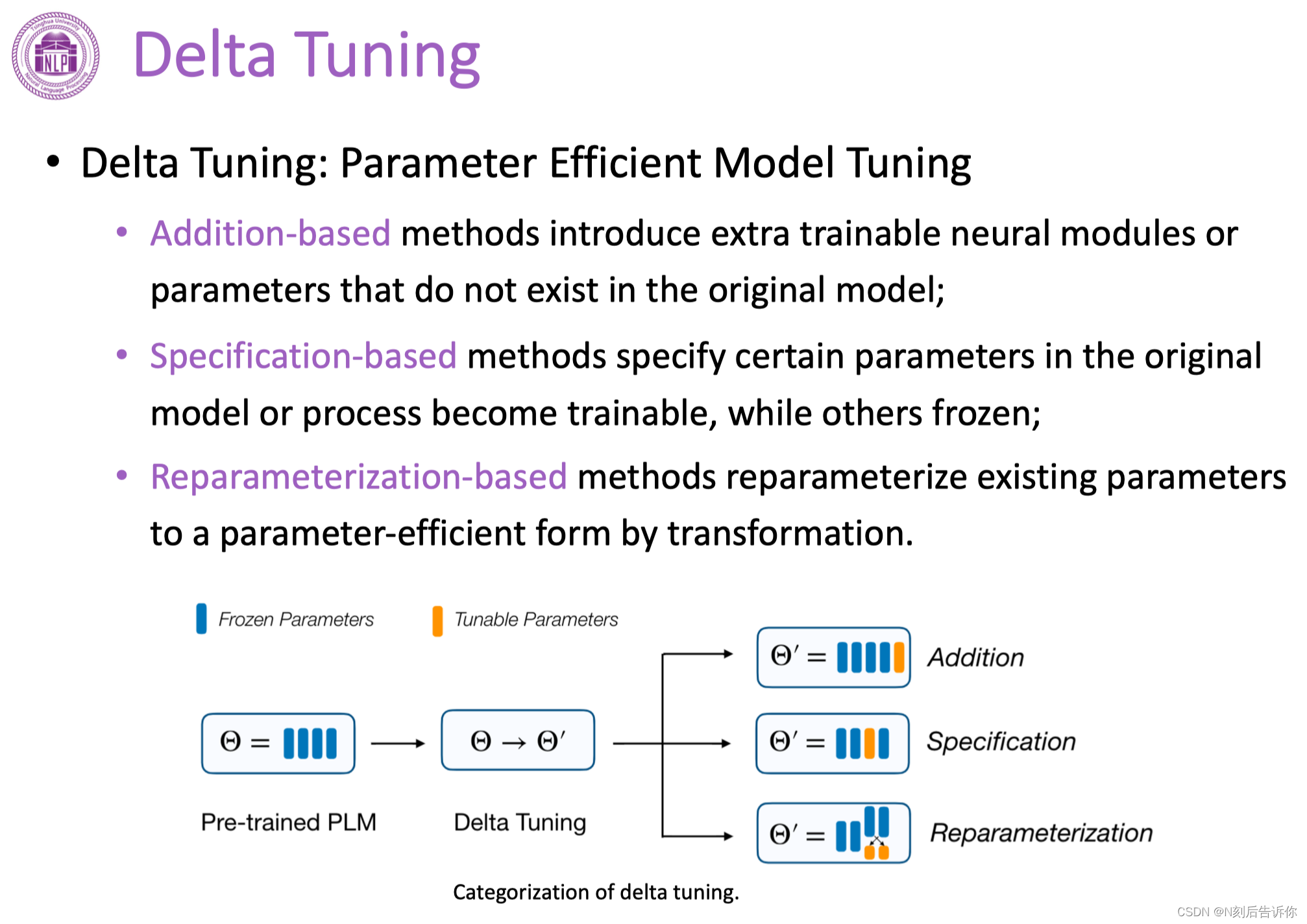

Delta Tuning可以分为:增量式、指定式、重参数化

增量式tuning

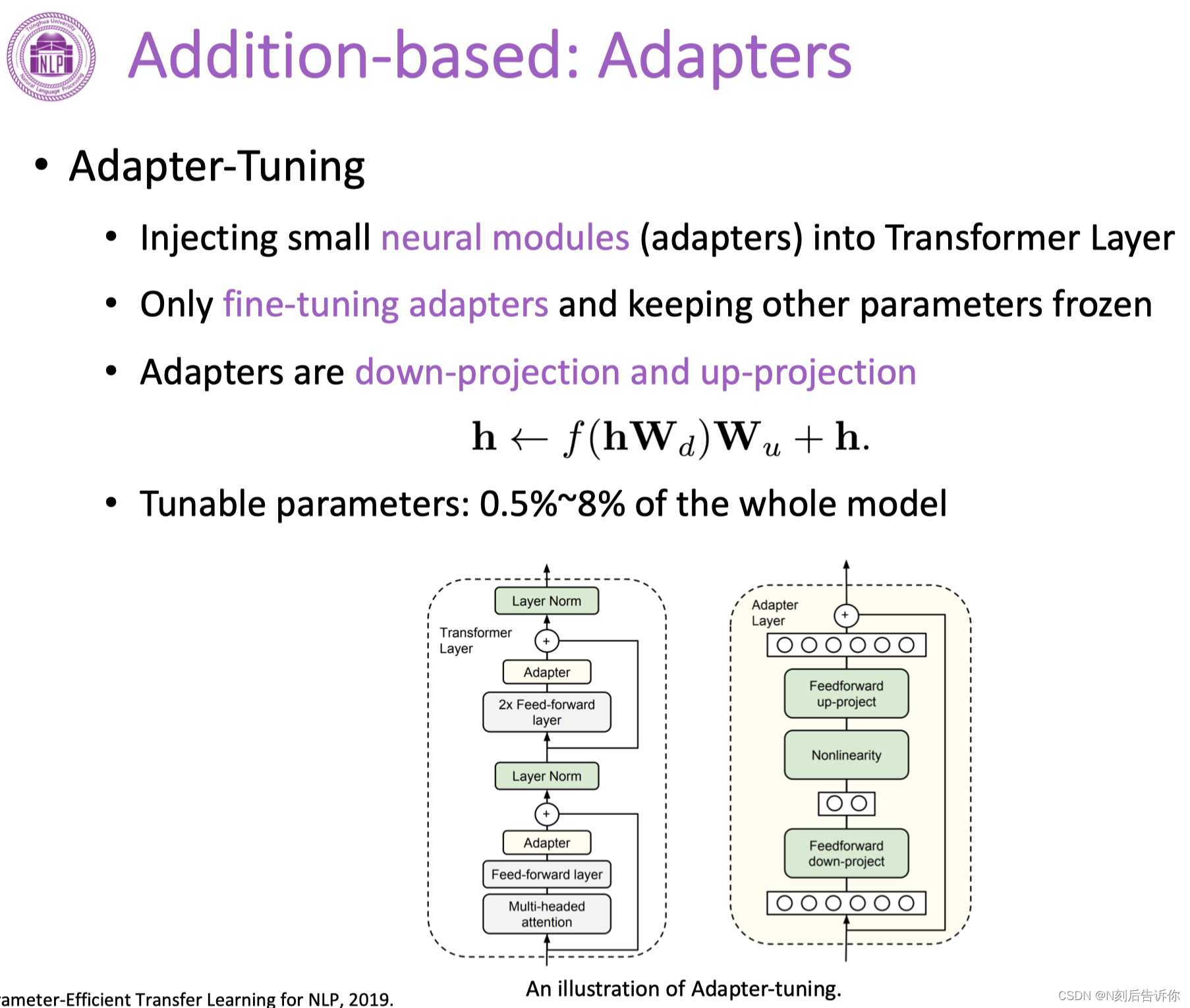

Adapter-Tuning

一层Transformer上加两层Adapter。

训练过程中只训练Adapter。可训练的参数量大约是0.5%-8%。

Prefix-Tuning