用Python来DIY一个AI面部情绪识别API的简单方案

基于人工智能的面部情绪识别API在很多场景都得到了应用,在人们情绪化消费、兴趣化消费的当下,如何察言观色,洞察用户真实的心理活动非常必要,对于大多数的人来说,这事非常有挑战,好在以ChatGPT为代表的大语言模型涌现出了‘初级智慧’,叠加行业数据训练之后,在理解人类情绪也有着出色的表现。幂简集成开放API平台整理了一批AI大模型API、情绪分析API接口供大家使用。

如果开发者不想直接用开放API接口来实现 面部情绪识别 功能,希望自己用Python开发语言定制一个达到同样功能的 面部情绪识别 的简单代码,可以尝试以下步骤。

第1步:设置环境

- 安装Python:确保你的系统上安装了Python。

- 创建虚拟环境(可选,但推荐):bash

python -m venv emotion_recognition_env source emotion_recognition_env/bin/activate - 安装所需库:bash

pip install numpy opencv-python tensorflow keras

第2步:准备预训练模型和AI训练数据

- 选择模型:有几种预训练模型可用于情绪识别,例如Keras应用程序中的模型或在FER-2013等数据集上训练的自定义模型。

- 准备数据

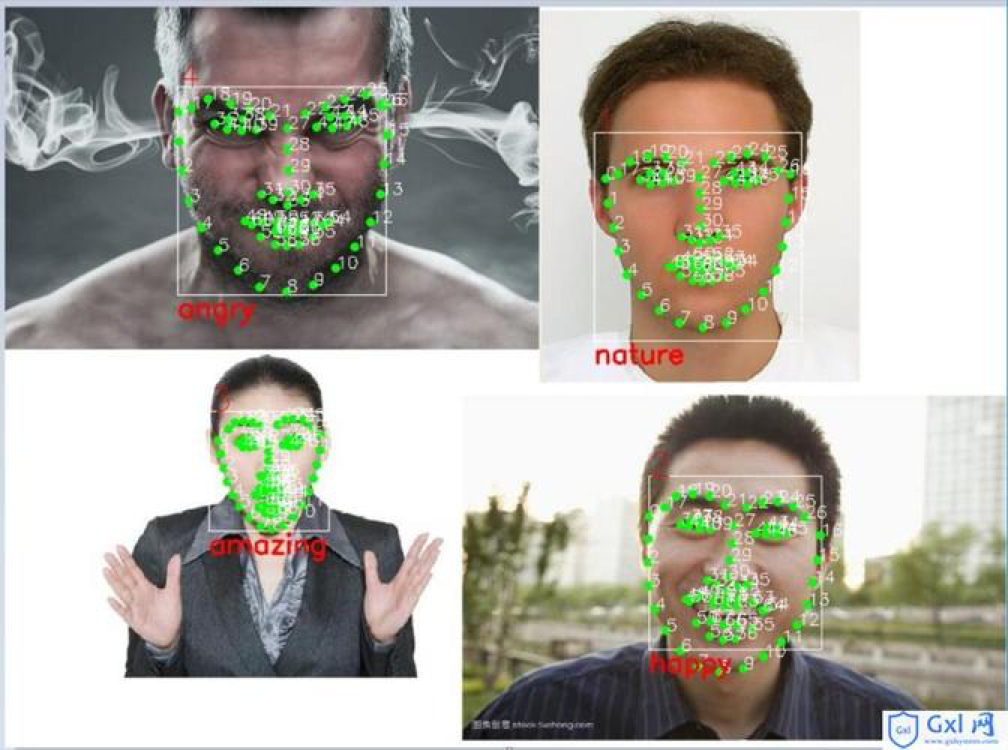

第3步:面部检测

- 使用面部检测库:OpenCV是面部检测的流行选择。

- 加载面部检测模型:

face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml')

第4步:预处理图像

- 检测面部:使用面部检测模型在图像中找到面部。

- 预处理检测到的面部:调整和规范化检测到的面部,以适应情绪识别模型的输入要求。

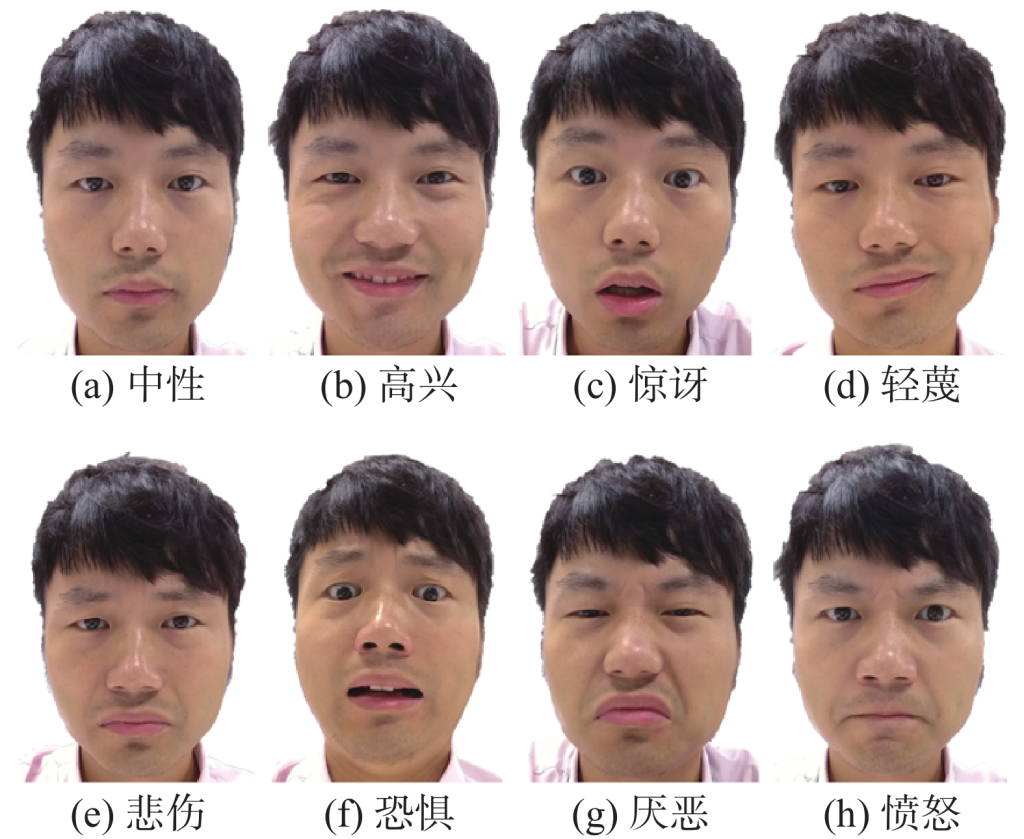

第5步:情绪识别

- 预测情绪:将预处理的面部图像通过情绪识别模型进行预测。

- 解释输出:模型将输出每个情绪类别的一组概率。

第6步:显示结果

- 绘制边界框:在检测到的面部周围绘制矩形。

- 标记情绪:在每个边界框上方放置预测的情绪。

第7步:与视频流集成(可选)

- 捕获视频:使用OpenCV从摄像头捕获视频。

- 处理帧:将面部检测和情绪识别应用于每一帧。

示例代码片段

这里有一个简单的示例来帮助你开始:

import cv2from keras.applications.fer2013_mini import FER2013Mini, preprocess_inputfrom keras.preprocessing import imageimport numpy as np# 加载模型model = FER2013Mini()# 加载图像img_path = 'path_to_your_image.jpg'img = image.load_img(img_path, target_size=(48, 48))x = image.img_to_array(img)x = np.expand_dims(x, axis=0)x = preprocess_input(x)# 预测情绪preds = model.predict(x)print('预测情绪:', np.argmax(preds[0]))# 加载面部检测模型face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml')# 读取图像img = cv2.imread(img_path)gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)# 检测面部faces = face_cascade.detectMultiScale(gray, 1.3, 5)for (x, y, w, h) in faces:cv2.rectangle(img, (x, y), (x+w, y+h), (255, 0, 0), 2)roi_gray = gray[y:y+h, x:x+w]roi = roi_gray.copy()roi = cv2.resize(roi, (48, 48))roi = preprocess_input(roi)roi = np.expand_dims(roi, axis=0)preds = model.predict(roi)cv2.putText(img, 'Emotion: ' + str(np.argmax(preds[0])), (x, y-10), cv2.FONT_HERSHEY_SIMPLEX, 0.9, (36,255,12), 2)# 显示图像cv2.imshow('Emotion Recognition', img)cv2.waitKey(0)cv2.destroyAllWindows()第8步:测试和优化

- 测试你的应用程序:使用不同的图像和视频流运行你的代码,看看它的性能如何。

- 优化你的模型:如果需要,用更多的数据重新训练你的模型或调整超参数。

总结

本案例只是用来学习,并无实际的商业应用价值,开发者也可以直接使用这些成熟的商业api,例如:

情绪分析 API-Twinword-Inc

情绪分析API接口-Metadata

Webit文本情绪分析